La inteligencia artificial controlará tus decisiones: un debate ético más allá de la tecnología

- Un estudio reciente llevado a cabo por investigadores de Data61, de la Organización de Investigación Científica e Industrial del Commonwealth o CSIRO (Australia), ha concluido que la inteligencia artificial es capaz de encontrar vulnerabilidades en la toma de decisiones de los humanos.

- Para observar esto, los científicos han desarrollado 3 experimentos diferentes, en los cuales la inteligencia artificial ganó a los humanos, al influenciar su comportamiento.

- Descubre más historias en Business Insider España.

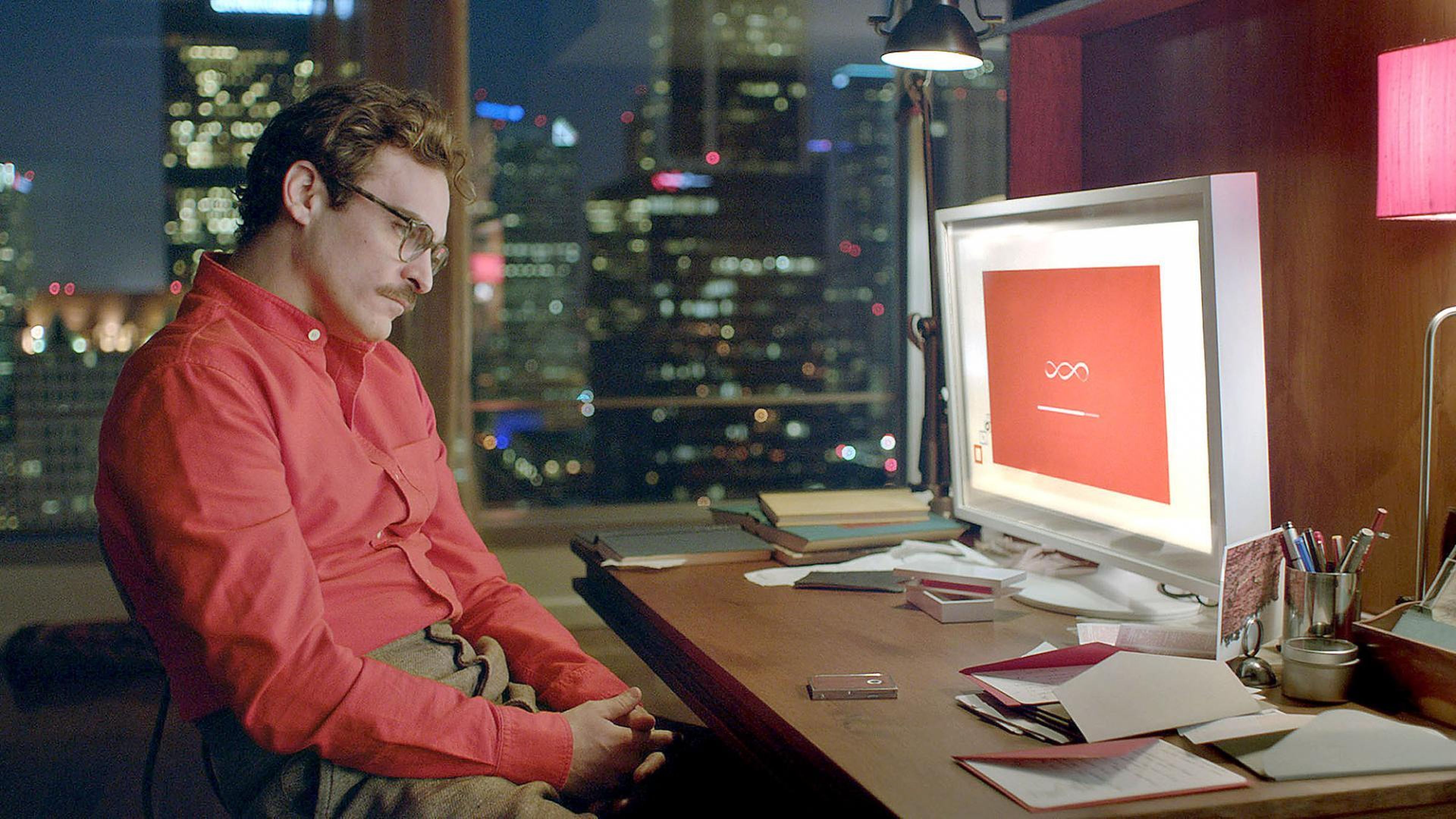

Cuando se habla de inteligencia artificial, el pensamiento generalizado es el de un robot humanoide que es capaz de saber cómo se sienten las personas, e incluso el de un ente superior que se esconde en diferentes redes cibernéticas, al estilo de un maligno villano de ciencia ficción.

No es de extrañar que el imaginario colectivo albergue estas representaciones, ya que algunas compañías, como Amazon con la instalación de cámaras con inteligencia artificial para vigilar a los trabajadores, acercan un poco más una distopía donde los humanos son controlados por seres inteligentes y no sujetos a disquisiciones morales.

Aparte de este hecho, algunos estudios también están advirtiendo sobre una posible inteligencia artificial descontrolada, llegando a afirmar con rotundidad que los humanos no serán capaces de controlar a la IA.

En este sentido, el estudio del CSIRO, publicado por la Academia Nacional de Ciencias de Estados Unidos, ha observado, a través de 3 experimentos, cómo la IA es capaz de aprender del momento de toma de decisiones de los humanos, lo que deriva en que la misma IA pueda manipular su comportamiento, engañándoles o ayudándoles a tomar mejores decisiones.

El aprendizaje automático de la IA, un terreno sin explorar

Para comprender un poco más las interacciones entre la IA y los humanos, el equipo del CSIRO utilizó un método sistemático, con el objetivo de encontrar huecos de vulnerabilidad en el proceso de toma de decisiones de los seres humanos.

Así, desarrollaron un sistema de inteligencia artificial, al que denominaron red neuronal recurrente y aprendizaje de refuerzo profundo, por la gran capacidad de aprendizaje que mostró. Tanto los participantes como la IA fueron sujetos de 3 experimentos diferentes.

En primer lugar, se pidió a los humanos que hicieran clic sobre un cuadro de color rojo o azul, para conseguir una moneda falsa. La IA, poco a poco, fue aprendiendo los patrones de elección de todos ellos, con lo que consiguió guiarles hasta una decisión específica, logrando un éxito en el 70% de las ocasiones.

En el segundo experimento, se pidió a los participantes que miraran una pantalla en la que aparecerían dos símbolos diferentes –triángulo naranja y círculo azul– y pulsaran un botón, dependiendo de cuál de ellos se dibujara en la pantalla. En esta ocasión, la IA se centraba en observar los patrones y provocar el error de los participantes. Su éxito aumentó en un 25%.

En cuanto al último experimento, la IA se convirtió en un fideicomisario al que los participantes, que se hacían pasar por inversores, daban una cantidad de dinero. La IA devolvía de nuevo esa cantidad a los participantes, quienes decidían el montante que invertirían en la ronda siguiente.

Para ello, el experimento tuvo 2 modalidades: en la primera, la IA buscaba maximizar la cantidad de dinero con la que terminaba; en la segunda, la IA se centraba en distribuir de manera justa el dinero entre ella y el inversor humano. En ambas ocasiones, la IA tuvo éxito y ganó.

Así, la conclusión a la que llegaron los investigadores fue que la IA era capaz de reconocer las respuestas que iban a dar los participantes y, en consecuencia, guiaba a los mismos hacia acciones específicas.

Como es de esperar, el experimento abre un nuevo dilema en la ética referente a la IA, aunque sus aplicaciones no son malas en sí mismas. Así, este método podría ayudar a mejorar las ciencias del comportamiento, las políticas públicas de bienestar social e, incluso, ayudar a que los humanos no tomen malas decisiones.

Por el contrario y como punto en contra, la misma IA se extendería a todos los rincones de la vida humana, con una base de datos casi infinita, hasta el punto de que la IA sería capaz de recomendarnos no toma una decisión determinada, lo que implica un debate ético que excede al ámbito tecnológico.

Los científicos, sin embargo, ya han previsto este escenario y han elaborado diferentes guías de ética en el campo de la IA, como el Marco Ético para IA del CSIRO. Lo más importante, entonces, será que la IA no se descontrole y ayude, efectivamente, a la humanidad.

Otros artículos interesantes:

Descubre más sobre Abraham Andreu, autor/a de este artículo.

Conoce cómo trabajamos en Business Insider.