Microsoft no solo muestra pornografía infantil en Bing sino que también la sugiere, según una investigación

- Una investigación realizada por TechCrunch y la startup AntiToxin ha confirmado que Bing, el buscador de Microsoft, muestra y sugiere pornografía infantil.

- Cuando se realizan las mismas búsquedas en Google, no aparecen los mismos resultados.

- Microsoft,explica que, obviamente, esto es "inaceptable" y que tomarán medidas al respecto.

- Sin embargo, la multinacional no quiso confirmar cuántas personas trabajaban como moderadores de IA de Bing o si pensaban aumentar ese departamento a raíz de los hechos acontecidos.

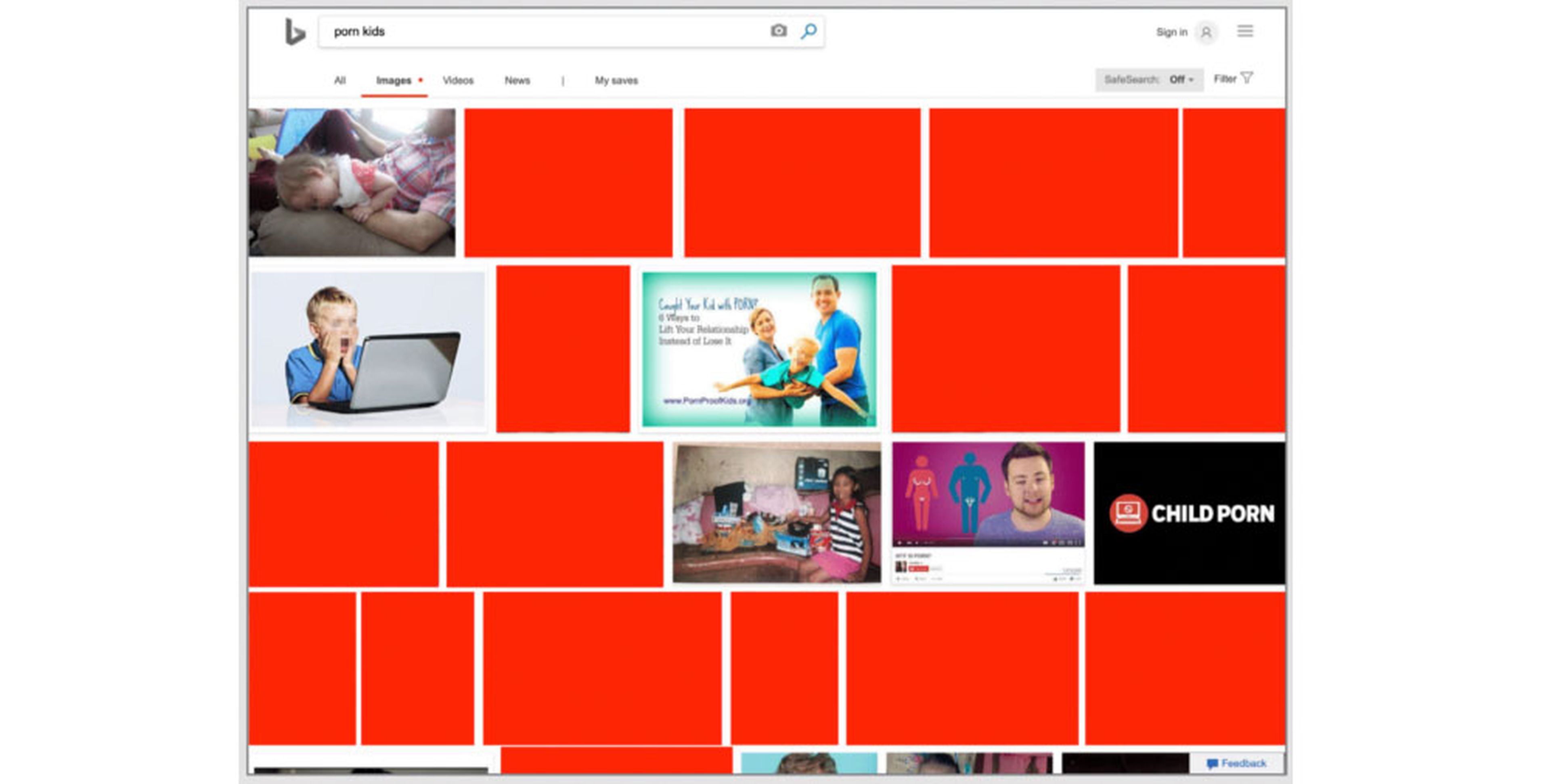

Encontrar pornografía infantil en Bing, el buscador de Microsoft, es extremadamente fácil. Pero lo más preocupante es que la plataforma sugiere imágenes y palabras clave relacionadas con este tema. Así lo demuestra una investigación realizada por TechCrunch y la startup AntiToxin.

El reportaje revela que, cuando el usuario busca términos en inglés como "porno de niños" o "porno CP" (una abreviación de pornografía infantil), así como "niños desnudos en familia" muestra imágenes de explotación infantil.

Cuando los investigadores pusieron en Bing "Omegle Kids", una popular app para hablar entre adolescentes, automáticamente, el buscador les sugería cosas como "Chicas de 13 Omegle Kids". Las instantáneas que revelaba a continuación eran de lo más alarmantes.

Esto refleja un fallo grave de seguridad dentro del buscador, ya que ofrece un amplio abanico de material a los pedófilos.

Según el medio, cuando se realizan las mismas búsquedas en Google, los resultados no son tan gráficos.

"No hay excusas posibles para una compañía de la talla de Microsoft, que solo el año pasado tuvo unos ingresos de 8.800 millones de dólares. Deberían realizar una mayor inversión para que no ocurran este tipo de errores", destaca TechCrunch.

Búsquedas que no son seguras... y no es la primera vez

El medio obtuvo esta información a través de un correo anónimo, que avisó del fallo. A continuación, se pusieron en contacto con AntiToxin para investigar el problema.

"Como padre, espero que las compañías dupliquen o tripliquen sus esfuerzos para mantener a nuestros hijos seguros. Ayudaremos a cualquier empresa que lo necesite que prometa que esto va a ser una prioridad en sus objetivos", señala Zohar Levkovitz, CEO de AntiToxin.

Por su parte, Jordi Ribas, vicepresidente de Bing y Productos de Inteligencia Artificial de Microsoft, explica que, obviamente, estos resultados de su buscador son "inaceptables" y que tomarían medidas de inmediato. "Actuaremos lo más rápido posible para que esto no vuelva a ocurrir. Haremos todo lo necesario para mejorar nuestro sistema", destaca el directivo.

La multinacional comunicó a TechCrunch que puso un equipo de ingenieros al cargo para solucionar este problema. Sin embargo, AntiToxin demostró que, aunque algunas cosas sí habían sido borradas, otras aún permanecen iguales.

Leer más: La empresa española que quiere dar lecciones de ética a las máquinas de inteligencia artificial

Pero, ¿cómo ha podido ocurrir algo así? Según la compañía, esto se debe a que la IA de Bing indexa todo lo que hay en la Red, al igual que Google, y que, a continuación, discrimina lo que es relevante o apropiado de lo que no. "Para que no ocurran estas cosas utilizamos la tecnología de PhotoDNA junto con moderadores humanos, pero no siempre es perfecto. Intentamos mejorar cada día", destacan.

Eso sí, la multinacional no quiso confirmar cuántas personas trabajaban como "moderadores de IA de Bing" o si pensaban aumentar ese departamento a raíz de los hechos acontecidos.

El problema es que no es la primera vez que ocurre algo similar. Una investigación de octubre de 2018 de HowToGeek confirmó que Bing sugería información racista, conspiranoíca, así como imágenes de pornografía infantil. Para ello, solo era necesario desactivar la búsqueda segura.

En cualquier caso, lo que demuestra esto es que la seguridad de la Inteligencia Artificial debería empezar a preocuparnos un poco más —especialmente a las tecnológicas— ya que sus peligros pueden estar más cerca de lo que pensamos.

Otros artículos interesantes:

Descubre más sobre Ana Muñoz de Frutos, autor/a de este artículo.

Conoce cómo trabajamos en Business Insider.