El debate sobre los riesgos de la inteligencia artificial en manos de la policía llega al Congreso: "La distopía del Gran Hermano se ha convertido en realidad"

- Unidas Podemos presenta una PNL en la Comisión de Interior de este jueves para proponer una agencia pública que regule los algoritmos.

- El escrito se detiene en los riesgos sociales que implica el uso de las tecnologías de vigilancia en manos de las Fuerzas y Cuerpos de Seguridad del Estado.

- Ismael Cortés es el diputado de UP que defenderá el texto en la Cámara Baja, y reivindica en Business Insider España la necesidad de hablar más sobre derechos digitales.

- Descubre más historias en Business Insider España.

El debate sobre quién y cómo se deben regular los algoritmos vuelve al Congreso de los Diputados, esta vez con el foco puesto sobre el uso que hacen de esta tecnología los cuerpos policiales y los gobiernos. Este jueves la Comisión de Interior en la Cámara Baja debate una proposición no de ley (PNL) presentada por dos diputados de En Comú Podem.

En la PNL, tanto Ismael Cortés como Joan Mena, diputados del grupo confederal de Unidas Podemos en el que se enmarca En Comú Podem, instan al Gobierno a promover "el desarrollo de estudios técnicos, éticos y jurídicos" para establecer una normativa sobre el uso de la IA usada por las Fuerzas y Cuerpos de Seguridad del Estado.

En el escrito remarcan que de esta forma la legislación española se alienaría con la regulación que se está discutiendo a nivel comunitario, como será el futuro Reglamento sobre la IA que lleva unos meses cocinándose en Bruselas y sobre el que España quiere convertirse en un país piloto en probar sus efectos de forma inédita, según avanzó Carme Artigas en Business Insider España.

También establecer "garantías" para que esos sistemas de IA no se utilicen con fines "discriminatorios", teniendo siempre en cuenta el "principio de precaución" en esas aplicaciones que de esta tecnología hagan los cuerpos policiales. Propone, además, "un régimen claro" para ver cuál es la responsabilidad jurídica en caso de "consecuencias adversas" de estos sistemas.

Por último, plantean que muchos algoritmos destinados "a la vigilancia masiva de la ciudadanía" sean supervisados por "una Agencia Estatal de Control de Algoritmos", de naturaleza similar a la Agencia Estatal de Protección de Datos (AEPD).

El año pasado, y tras la oleada de protestas del movimiento Black Lives Matter, grandes tecnológicas como Microsoft, Amazon o IBM anunciaron que dejarían de vender sus soluciones en reconocimiento facial a las policías del país norteamericano.

La Comisión de Interior se celebrará este jueves después de que termine el Pleno, previsiblemente a partir de las 16:00 horas. Ismael Cortés, el diputado que firma esta PNL, explica a Business Insider España que una de las razones por las que han presentado el escrito es que el debate sobre los derechos digitales todavía es escaso en las Cortes.

El Ministerio de Trabajo se convirtió en un referente europeo y propuso en la ley de ridersuna comisión que estudie las repercusiones laborales de los algoritmos. Los sindicatos y reguladores europeos se fijaron en la norma cuando esta entró en vigor para trazar cuál será la normativa comunitaria que aborde los problemas algorítmicos en la gig economy.

Pero la famosa ley de riders no puede ser la punta de lanza para abordar todos los desafíos de la sociedad digital, que en palabras de Cortés, "también entraña riesgos". "Deberíamos ampliar la idea a todos los ámbitos de la sociedad".

"Tengamos en cuenta que la sociedad digital es ya una realidad. La cantidad de datos, el flujo masivo de datos que circula por las redes y por los sistemas informáticos es mucho mayor al que circula en papel. Pero falta una regulación absoluta, por un lado sobre el ámbito empresarial", explica.

El diputado no se refiere únicamente a las fábricas, a pesar de que según algunos estudios España ya es el país con más empresas usando datos para mejorar procesos o vigilar empleados en toda Europa. "También nos referimos a espacios como los centros comerciales, donde hay muchas cámaras de vigilancia. Recopilan una importante cantidad de datos personales".

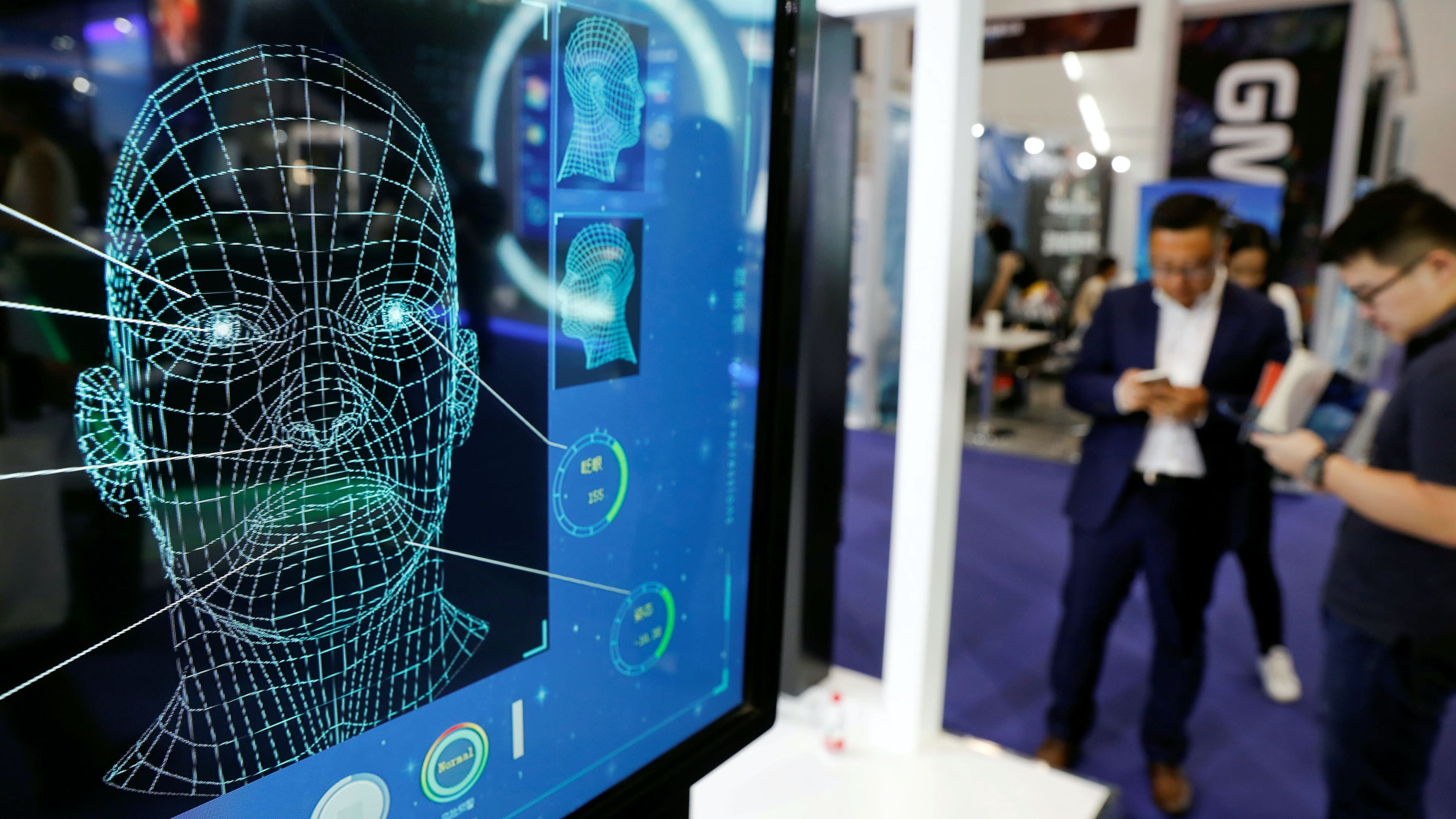

"Y la ciudadanía no tiene ningún tipo de control sobre el diseño de esa recolección de datos, sobre su uso, sobre su seguimiento y sobre el impacto que puede provocar", lamenta Cortés. "Es una tecnología que quizá haya llegado para quedarse, y que ya se ha implementado en otros países europeos". El diputado se refiere a las cámaras con sistemas de reconocimiento facial.

"Urge un debate público y ciudadano"

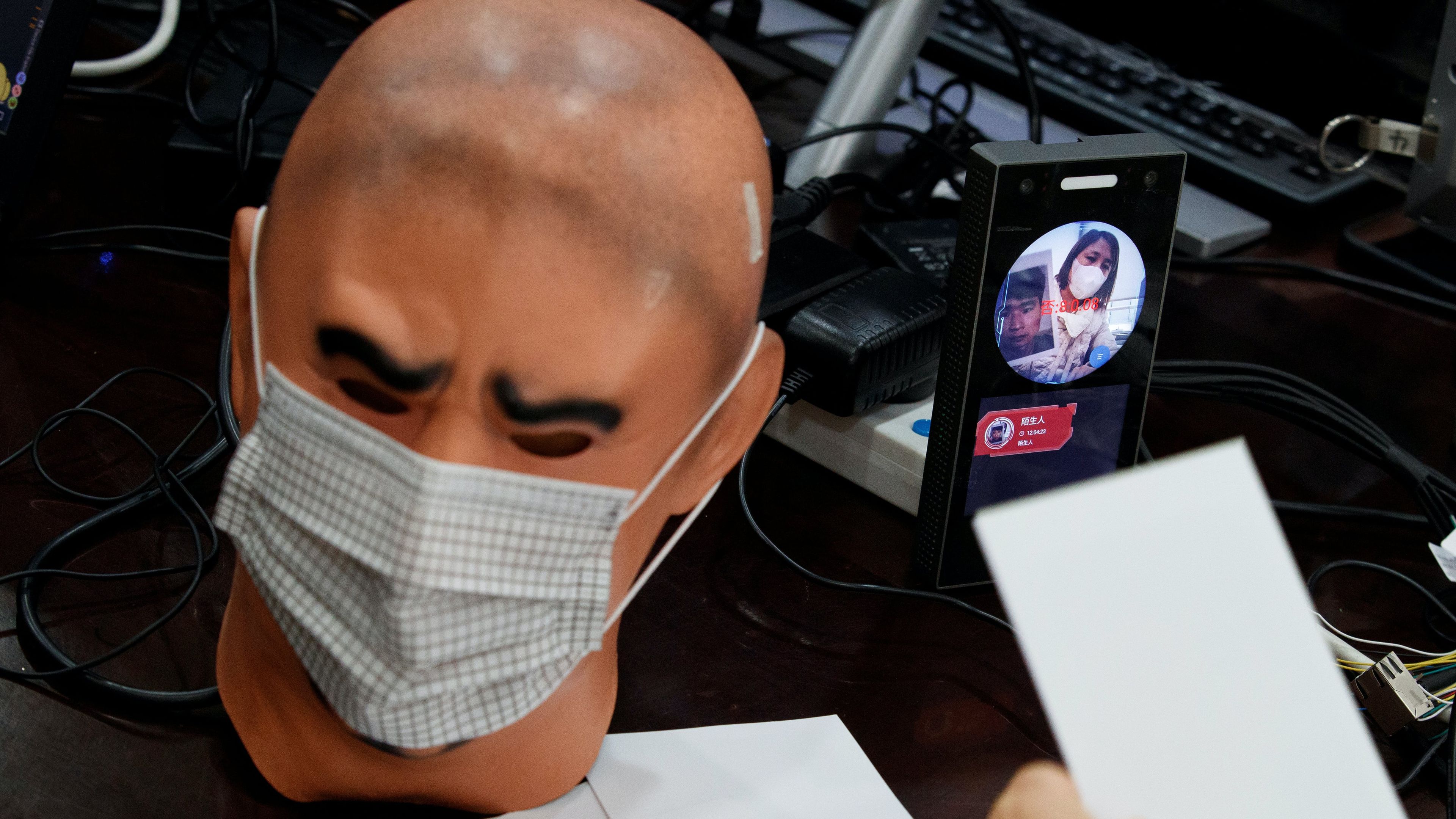

REUTERS/Damir Sagolj

Por eso el parlamentario considera urgente comenzar "un debate académico, mediático, público", en definitiva "un debate ciudadano, y no solo político" para hablar "qué suponen este tipo de tecnologías invasivas". "Las cámaras ya no están solo en las calles: están en el ordenador, en los móviles, vigilando a nuestros hijos. En los lugares más íntimos de nuestro hogar".

"La distopía del Gran Hermano que escribió George Orwell se ha convertido en una realidad y llega hasta unos límites que entonces el propio autor era incapaz de sospechar".

Cuando se plantean propuestas como la creación de una agencia que regule los algoritmos, las empresas suelen defender que ese tipo de iniciativas pueden limitar su capacidad de innovar. Frente a ello, el diputado de En Comú Podem defiende varios argumentos.

"Creo que el mayor de esos argumentos es el que se ha situado en el debate público, mediático e incluso político: el caso de Facebook". Se refiere a las filtraciones que ha protagonizado una extrabajadora de la multinacional de Mark Zuckerberg, Frances Haugen, quien compareció en el Parlamento Europeo semanas atrás.

"En este caso, según revelan las trabajadoras y trabajadores que han tenido acceso a su caja negra, quienes más padecen adicciones digitales son los adolescentes. Luego, uno de los mayores argumentos son los enormes riesgos que presentan estos algoritmos para la salud mental, especialmente de los más jóvenes", apostilla.

Otros riesgos que nacen con la IA en manos de cuerpos policiales son que las capacidades predictivas de esta tecnología acaben generando discriminaciones. Ya lo explicó el propio Cortés en El Salto hace unos días, y recuerda a este medio: "Lo que harán estos predictores es analizar qué aspecto tenían, qué ropa llevaban o qué hacían personas justo antes de cometer un hecho delictivo".

"Puede servir para reconocer tendencias, pero un dato así jamás puede ser un fundamento para incriminar o aplicar una vigilancia especial a determinados individuos, que siempre deben tener derecho a la presunción de inocencia", abunda. "El uso de la predicción de comportamientos individuales y colectivos es un riesgo creciente".

La PNL, que se espera que prospere en la Comisión de Interior, será la antesala de un debate público que irá en aumento. Cortés da la bienvenida a reglamentos europeos como el que regularán los sistemas de inteligencia artificial en toda la Unión. Su temor es que estas nuevas regulaciones tarden en transponerse a la legislación española, o no se transpongan adecuadamente.

"En el subtexto de esta PNL", continúa Cortés, "hablamos de precaución en todas las aplicaciones de IA en el contexto policial. Habrá que hacer una mención especial a las actuaciones policiales en el contexto de frontera". Y es que hasta hace no mucho se puso sobre la mesa la idea de tener un sistema de reconocimiento facial en fronteras como la de Ceuta o Melilla.

Europa quiere regular así la tecnología en su interior que espera que blinde sus vallas en el exterior.

Otros artículos interesantes:

Descubre más sobre Alberto R. Aguiar, autor/a de este artículo.

Conoce cómo trabajamos en Business Insider.