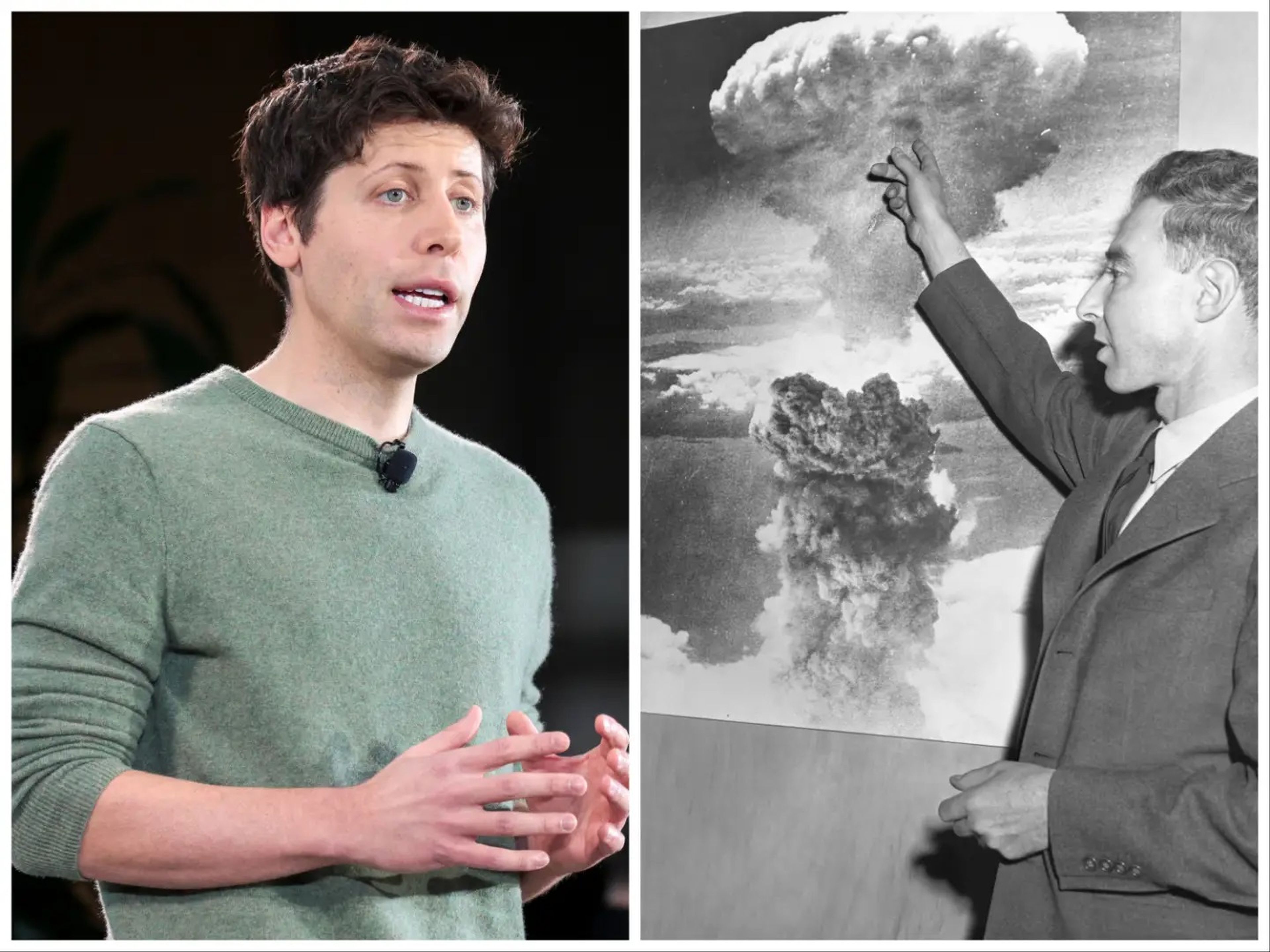

Sam Altman comparó la importancia de OpenAI con la del Proyecto Manhattan y citó a Oppenheimer, padre de la bomba atómica

JASON REDMOND/AFP vía Getty; Bettmann/Getty

- Sam Altman, CEO de OpenAI, comparó en 2019 las aspiraciones de OpenAI con la escala del Proyecto Manhattan, que dio lugar a las primeras armas nucleares de la historia.

- "¿Estoy haciendo algo bueno? ¿O algo realmente malo?", se preguntó Altman, en una charla en la que citó a Robert Oppenheimer, padre de la bomba atómica, y aseguró que la inteligencia artificial debe progresar a pesar de los posibles riesgos.

Sam Altman, CEO de OpenAI (la compañía desarrolladora de ChatGPT o DALL-E), comparó hace unos años la importancia de su empresa con la del Proyecto Manhattan, nombre en clave utilizado por el gobierno estadounidense para designar el proyecto encargado de fabricar la primera bomba atómica durante la Segunda Guerra Mundial.

Según el New York Times, en el año 2019, apenas unos días después de que Microsoft se comprometiese a invertir mil millones de dólares en su compañía, Altman habría declarado a Cade Metz, periodista de tecnología de ese medio, que la fabricación de la primera bomba nuclear era un "proyecto de escala similar a la de OpenAI: el nivel de ambición al que aspiramos".

Metz afirma que el CEO de OpenAI también citó al líder del Proyecto Manhattan, Robert Oppenheimer (comúnmente conocido como "padre de la bomba atómica"), en un discurso de 1945 en el que justificó la creación de las bombas que devastaron Hiroshima y Nagasaki como una expansión necesaria del conocimiento humano.

"La tecnología surge porque es posible", habría expresado Altman, según el New York Times, a lo que habría añadido que Oppenheimer y él compartían la misma fecha de cumpleaños, el 22 de abril.

El principal objetivo de OpenAI es lograr alcanzar la ansiada inteligencia artificial general —el punto en el que la IA llegue a ser igual de inteligente que un humano— y hacerlo de forma segura, según una publicación de la empresa en su blog oficial. Sin embargo, su rápido desarrollo, con la llegada de GPT-4 apenas unos meses después de la publicación del 3, ha suscitado inquietud.

El 36% de los participantes en una encuesta de la Universidad de Nueva York (Estados Unidos) señalaron estar preocupados por que la tecnología pudiera provocar una "catástrofe de escala nuclear", mientras que algunos expertos han indicado que la IA "no se preocupa por nosotros ni por la vida inteligente en general".

Un informe de Goldman Sachs publicado la semana pasada sugería que la inteligencia artificial podría afectar a 300 millones de puestos de trabajo a tiempo completo. Prueba de ello es que ya está siendo utilizada, por ejemplo, para redactar cartas de presentación, escribir libros infantiles o como método para copiar trabajos académicos.

Altman advirtió de que la IA conlleva un "grave riesgo de uso indebido, accidentes drásticos y trastornos sociales" en una entrada del blog de OpenAI en febrero. En la conversación de 2019 con el periodista del Times, el empresario también se habría preguntado: "¿Estoy haciendo algo bueno? ¿O algo realmente malo?".

El director general de la desarrolladora de ChatGPT ya aseguró al Wall Street Journal que, bajo su criterio, una renta básica universal podría compensar los puestos de trabajo sustituidos por la inteligencia artificial, permitiendo a la gente dedicarse a trabajos más creativos.

Según este medio de comunicación, Altman forma parte de una junta de seguridad conjunta con Kevin Scott, CTO de Microsoft (una de las principales impulsoras de OpenAI), que tiene la capacidad de dar marcha atrás al lanzamiento de cualquier producto si se considera puede ser demasiado peligroso para la sociedad.

OpenAI fue objeto de nuevas críticas la semana pasada, cuando miles de líderes y expertos tecnológicos —entre ellos, Elon Musk, CEO de Tesla, o Steve Wozniak, cofundador de Apple— firmaron una carta abierta en la que pedían que se detuviese el desarrollo de la IA generativa durante al menos 6 meses.

"Los sistemas de IA más potentes solo deberían desarrollarse cuando estemos seguros de que sus efectos serán positivos y sus riesgos serán asumibles", sugería el manifiesto.

El viernes pasado, la agencia nacional de protección de datos italiana anunció que bloqueaba el acceso a ChatGPT en Italia y que iba a comenzar una investigación contra OpenAI. El regulador italiano aludió a una vulneración de la regulación en materia de protección de datos y al uso de datos privados para entrenar el algoritmo de su generador de texto.

Otros artículos interesantes:

Conoce cómo trabajamos en Business Insider.