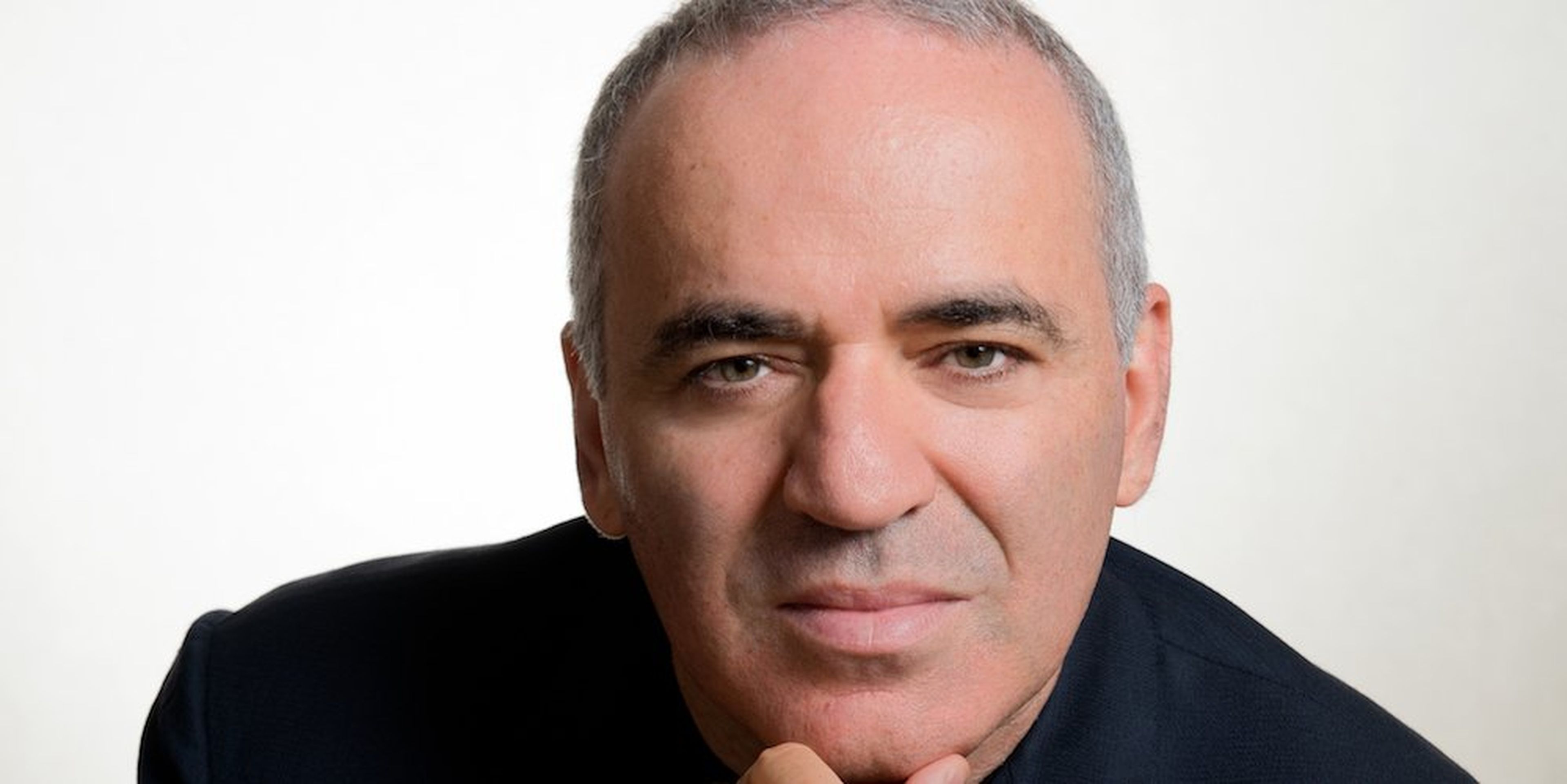

El gran maestro del ajedrez Garry Kasparov y lo que ocurre cuando las máquinas "alcanzan un nivel contra el que los humanos no pueden competir"

Lisboa (Portugal). Garry Kasparov afirma que ya sabía en 1997, hace 20 años, que los humanos estaban abocados al fracaso. En mayo de ese año, en Nueva York, perdió un match a seis partidas contra Deep Blue, el ordenador de ajedrez más potente del momento, que había diseñado IBM.

Hoy en día, parece evidente que Kasparov iba a perder: la capacidad de un ordenador de calcular movimientos en una partida por "fuerza bruta" es infinitamente mayor que la humana. Pero se tiende a olvidar que el reto contra Deep Blue constaba de dos matches, y que Kasparov ganó el primero en Filadelfia, en 1996. Entre ambos, IBM reestructuró su máquina y Kasparov acusó a IBM de hacer trampas, aunque posteriormente se retractó de algunas de sus acusaciones.

Kasparov podría haber ganado la segunda serie de no haber cometido un error en la segunda partida, cuando no fue capaz de ver un movimiento que podría haber forzado tablas.

Deep Blue también cometió un error en la primera partida: en el momento, Kasparov lo atribuyó por error a una "inteligencia superior" de Deep Blue, que le permitía realizar movimientos inesperados y antinaturales.

En cualquier caso, en una conversación con Business Insider en el Web Summit de Lisboa, celebrado el pasado mes de noviembre, Kasparov afirmó que en ese momento se dio cuenta de que los humanos estaban "condenados" en el terreno de los juegos.

Mientras que una máquina pueda seguir unas reglas establecidas teniendo en cuenta el objetivo final, incluso aunque esto sea lo único que sepa, es suficiente para que alcance un nivel contra el que ningún humano puede competir.

"Ya veía la tendencia", explicó. "Ya veía que es, en fin, una calle de sentido único. Por eso yo predicaba que había que colaborar con las máquinas como forma de reconocer que, en el terreno de los juegos, los humanos estaban condenados."

Dijo que no le sorprendió el éxito de AlphaGo, o el jugador artificialmente inteligente de Elon Musk para "Dota 2" (un videojuego), "porque incluso con la información limitada que se les da a estas máquinas, tienen claro el objetivo".

"Se trata de establecer unas reglas", explicaba Kasparov. "Y al establecer las reglas, se establecen unos límites. Mientras que una máquina pueda seguir unas reglas dadas teniendo en cuenta el objetivo final, incluso aunque esto sea lo único que sepa, será suficiente para que alcance un nivel contra el que ningún humano puede competir".

Kasparov ha escrito un libro sobre inteligencia artificial titulado Deep Thinking: Where Machine Intelligence Ends and Human Creativity Begins (Pensamiento profundo: Dónde termina la inteligencia de las máquinas y comienza la creatividad humana). También es embajador de la empresa de ciberseguridad Avast.

Nuestra primera pregunta fue sobre la fuerza bruta y sobre si la inteligencia artificial se sustenta en enormes bases de datos para tomar decisiones, en lugar de en un pensamiento o aprendizaje reales.

"En el terreno de los juegos las máquinas mandan porque los humanos cometen errores"

Jim Edwards: Usted dijo en una ocasión, refiriéndose a la inteligencia artificial, que nos encontramos "en el terreno en el que la máquina gana porque los humanos cometen errores", es decir, que la principal ventaja de la inteligencia artificial es que los humanos cometen errores y las máquinas no. ¿Eso sigue siendo cierto?

Garry Kasparov: La naturaleza humana no ha cambiado desde que dije eso. Los humanos están abocados a cometer errores porque nosotros (incluso los mejores, sea en ajedrez o en golf o en cualquier otro juego) no podemos mantener la misma constancia que una máquina.

Edwards: ¿La ventaja de la inteligencia artificial radica entonces solamente en su constancia? ¿En que no cometerá errores?

Kasparov: Hay que establecer la diferencia entre lo que [el matemático estadounidense Claude] Shannon clasificó como máquinas de tipo A y máquinas de tipo B.

Las máquinas de tipo A, basadas en la fuerza bruta, emplean una mezcla entre esta y un algoritmo: podría llamarse inteligencia artificial, porque se parece al modo en que los humanos toman decisiones.

Por cierto, todos los padres de la ciencia computacional, como Shannon, [Alan] Turing o [Norbert] Weiner creían que el auténtico éxito, lo rompedor, lo lograrían las máquinas de tipo B, las humanoides.

"La constancia es lo que resulta mortal para los humanos, porque hasta los mejores de nosotros no lo somos"

Edwards: ¿Esas máquinas humanoides podrían cometer errores?

Kasparov: Todas las máquinas cometen errores, que no se me malinterprete. Porque incluso las máquinas de tipo A más potentes, las de fuerza bruta, son incapaces de tenerlo todo en cuenta.

Deep Blue tenía una velocidad endiablada en 1997: era capaz de procesar 2 millones de posiciones por segundo. Pero el número de movimientos legales en una partida de ajedrez es de 10 elevado a 40. Por eso la clave no es la velocidad: la clave son determinadas consideraciones que la máquina tiene que hacer solo mediante movimientos del punto A al punto B. Las máquinas no son profetas; las máquinas pueden resolver una partida o un objetivo.

Pero no se trata simplemente de resolver un problema: se trata de ganar. Y por eso las máquinas también pueden cometer errores. Aunque cuando se estudia la calidad media del movimiento, es bastante constante. Conque la constancia es lo que resulta letal para los humanos, porque hasta los mejores de nosotros no lo somos. Si se estudian las mejores partidas disputadas por los mejores jugadores en un campeonato del mundo, se observa que en las partidas no hay disparates o errores, sino imprecisiones obvias.

"Es una calle de sentido único. Por eso yo defendía que había que colaborar con las máquinas como forma de reconocer que, en el terreno de los juegos, los humanos estaban condenados"

Edwards: Un ejemplo sobre el que usted escribe es que, en el ajedrez, a los humanos les disgusta profundamente deshacerse de su reina por ser la pieza más poderosa del tablero, incluso cuando hacerlo supone una ventaja.

Kasparov: Si hablamos de jugadores profesionales, hacen todo lo necesario para ganar. Si hablamos de lo mejor de lo mejor, sigue siendo posible que se den inexactitudes debido al hecho de que los jugadores se pueden cansar. Pueden bajar la guardia.

Psicológicamente, cuando uno lleva ventaja, puede pensar: "Está bien, se acabó la partida", y se puede relajar. Mientras que en el juego humano no importa —porque estas ventajas siempre se recuperan— frente a una máquina llevas las de perder. Por eso todos los sistemas cerrados (y los juegos lo son) les dan a las máquinas una ventaja automática.

Hoy en día, las máquinas son absolutas bestias.

Lo sé desde 1997. Si tenemos en cuenta la fortaleza absoluta de los ordenadores de ajedrez, Deep Blue era relativamente débil según los estándares modernos. Hoy en día, las máquinas son absolutas bestias. Son mucho más potentes que Magnus Carlsen, y es probable que una aplicación gratuita para tu móvil sea más potente que Deep Blue.

Ya veía la tendencia. Ya veía que es, en fin, una calle de sentido único. Por eso yo defendía que había que colaborar con las máquinas como forma de reconocer que, en el terreno de los juegos, los humanos estaban condenados.

No me sorprende el éxito de AlphaGo, o el jugador artificialmente inteligente de "Dota" de Elon Musk, porque incluso con la información limitada que se les da a estas máquinas, tienen claro el objetivo. Se trata de establecer unas reglas. Y al establecer las reglas, se establecen unos límites. Mientras que una máquina pueda seguir unas reglas dadas teniendo en cuenta el objetivo final, incluso aunque esto sea lo único que sepa, es suficiente para que alcance un nivel contra el que ningún humano puede competir.

"Mientras que muchos están muy impresionados por que AlphaGo arrasase a los mejores jugadores de Go, para mí eso solo demuestra lo escaso que es el conocimiento humano del juego"

Edwards: ¿Qué sintió al perder contra Deep Blue?

Kasparov: Perder siempre es malo. Así fue en mi caso. Quiero decir: malos sentimientos. Para mí fue, simplemente, la primera derrota en el match. No contra la máquina: solo contra el ajedrez.

En mi libro Deep Thinking confieso que fui un mal perdedor y que me enfadé mucho, y que todas mis críticas iban dirigidas al modo en que IBM había organizado el match. Mantengo muchas de mis críticas, pero le doy, en el libro, mucho reconocimiento al equipo científico de IBM. Eso ya es agua pasada.

Edwards: Es un momento histórico...

Kasparov: Es un momento histórico, pero era una máquina de fuerza bruta, no una máquina humanoide, la máquina de tipo B que en teoría debería triunfar en el juego del ajedrez. Pero, tal y como descubrimos, el ajedrez era vulnerable a máquinas muy potentes con algoritmos suficientes, mayores bases de datos y procesadores de alta velocidad.

Así que si se estudia el Go, ya estamos ante un tipo de máquina muy diferente: un programa con un aprendizaje profundo. No es que la máquina se sustente total o parcialmente en la fuerza bruta. Sigue siendo fuerza bruta, pero ya incluye elementos de aprendizaje profundo. Mientras que muchos están muy impresionados por que AlphaGo arrasase a los mejores jugadores de Go (y que luego AlphaGo Zero, que no sabía nada más que las reglas, arrasase a AlphaGo), para mí esto solo demuestra lo escaso que es el conocimiento humano del Go.

El Go es muy complejo. Lo que los mejores jugadores de Go de hoy en día saben sobre el juego probablemente se corresponda con lo que los mejores del ajedrez sabían hace 200 años. Si fuese posible mostrar las partidas de ajedrez modernas a los mejores jugadores del siglo XIX, se quedarían atónitos, porque eso escaparía por mucho a su imaginación.

Pero permítame insistir en ese punto: es un sistema cerrado, del tipo en el que las máquinas siempre dominarán. Las máquinas siempre harán mejor cualquier cosa que sea cuantificable, y no deberíamos dar por sentado que se puede transferir de manera automática el conocimiento de un sistema cerrado a un sistema abierto.

"Las máquinas pueden resolver cualquier problema, pero no saben qué problema es el importante"

Edwards: En lo que se refiere al aprendizaje profundo, en donde la máquina tiene que aprender por sí sola, no interviene únicamente la fuerza bruta. Ha hablado sobre lo complicado que es darle un objetivo a una máquina: carecen de intención. Hacen lo que se les dice, la máquina no desea por sí misma.

Kasparov: Se trata de identificar el objetivo.

Edwards: ¿Qué importancia tiene la intención en la inteligencia artificial del futuro? ¿Es posible dotar a una inteligencia artificial de intenciones?

Kasparov: Las intenciones brotan de preguntas, y las máquinas no hacen preguntas. Para ser más precisos, pueden formular preguntas, pero no saben distinguir cuáles son las importantes. Es como una limitación, porque la máquina no entiende el concepto de "rendimientos decrecientes." Puede seguir hasta el infinito. Por tanto, en el momento en el que existe una intención, un objetivo, se alcanza esa frontera en la que la máquina se detiene.

Lo que preveo en el futuro más o menos cercano son unas probabilidades ínfimas, si es que hay alguna, de que las máquinas puedan fijar sus objetivos. Creo que esto entraría en contradicción con el modo en que funcionan las máquinas, porque conocen las probabilidades, pueden trabajar con patrones, pero la intención... Eso es lo que extrapola sistemas abiertos a sistemas cerrados. Tienes que poder entender lo que es importante.

Una vez di una conferencia, y detrás de mí hablaba una profesora de Cornell. Hablaba sobre esto, y decía: "Las máquinas pueden resolver cualquier problema, pero no saben qué problema es el importante".

"Siendo como soy alguien que creció en la Unión Soviética, ya sé lo suficiente sobre dictadores y el modo en que funcionan. ¿Cómo asumir el hecho de que estamos entregando de buen grado tanta información personal por conveniencia?"

Edwards: ¿Por qué le interesa tanto la seguridad?

Kasparov: Reúne algunos elementos de mi vida y, por tanto, lo que más me interesa en mi vida actual. Tiene que ver con la inteligencia artificial y con la tecnología, pero también con los derechos individuales. Me he pasado años avisando del peligro que supone la tecnología moderna en manos de gente mala que busca dañar nuestro estilo de vida.

Ahora creo que ha llegado ese momento: Nos enfrentamos a un gran reto. Dejemos a un lado a Putin y a Kim Jong-Un y a todos esos terroristas y dictadores; nuestra sociedad está experimentando un cambio radical debido a la tecnología. Hay muchos problemas que me interesan, por ejemplo, en los blogs, como la libertad de expresión contra el discurso del odio.

Antes vivíamos en un entorno en el que podíamos separar el bien del mal sin dificultad. Ahora, nos encontramos con que es imposible parar el caudal de información negativa y de cosas que no queremos ver a menos que se impongan regulaciones estrictas (cosa que no me gusta). Ahora tenemos que tomar decisiones difíciles por nosotros mismos: es lo que está ocurriendo en el tiempo de las noticias falsas, de las fábricas de trolls y de elementos maliciosos.

Pero también hay un gran problema. Creo que es importante para mí como presidente de la Human Rights Foundation, y como alguien que creció en la Unión Soviética y sabe algo de dictadores y del modo en que funcionan: ¿Cómo asumir el hecho de que estamos entregando de buen grado tanta información personal por conveniencia? Porque queremos aprovechar todas esas ventajas, sin querer darnos cuenta de que si estás conectado al mundo, tu información va a ser almacenada. ¿Cuál va a ser el resultado de esta enorme colección de datos individuales, del almacenamiento de toda esa información por parte de gigantes multinacionales y empresas?

Solo estoy intentando dar con una... no diría "solución" racional; más bien trato de transmitir la idea de que aún está por ver la diferencia entre el almacenaje de datos de Google y el KGB. Incluso aunque se trate de Google, de una compañía estadounidense, ¿cómo podemos estar seguros de que esta información no se utiliza para perjudicar a personas?

Esas son cuestiones que me importan. Avast también está comprometida con la utilización de inteligencia artificial para proteger a sus clientes de toda clase de software malicioso. Y aunque no soy un experto en tecnología, sí estoy convencido de que esto es lo que hay que hacer. Es decir, proteger a las personas de todo tipo de amenazas a las que se enfrentan hoy, en este mundo emocionante y moderno, pero peligroso.

Conoce cómo trabajamos en Business Insider.