Una de las IA más avanzadas para generar textos ha escrito parte de este artículo, que termina hablando sobre el fin de la humanidad: "Su futuro es incierto"

- OpenAI es la desarrolladora de GPT-3, un modelo de IA que es capaz de generar texto con sentido y es una de las más avanzadas de su clase.

- Se ha entrenado con texto escrito en internet, con lo que puede presentar problemas por sesgos, machismo, misoginia o racismo.

- Business Insider España se ha propuesto en este artículo dejar que GPT-3 lo termine. Ha acabado cuestionando la viabilidad de la raza humana.

- Descubre más historias en Business Insider España.

GPT-3 ha sido considerado, durante años, el modelo de procesado de lenguaje natural más entrenado del mundo. En síntesis, se trata de una inteligencia artificial capaz de escribir como un humano. Aunque lo que escriba no tenga ningún tipo de sentido.

Ahora, los desarrolladores del GPT-3 han liberado una API con la que los usuarios de la red pueden 'jugar' con esta plataforma. Lo pueden hacer completamente gratis registrándose en esta web y buscando la opción de Playground.

La prestigiosa publicación MIT Technology Review detalló hace exactamente un año cómo la tecnología de GPT-3 tenía un problema. Se había entrenado con texto publicado en internet. La IA, que se emplea en bots de chat en varios idiomas, podía llegar a ser racista, misógina, homófoba...

Con todo, el procesado de lenguaje natural es uno de los pocos campos en los que un modelo de IA puede seguir causando sorpresa a un ser humano. Sobre todo, teniendo en cuenta que como reflejaba en un contundente informe una eminencia española en computación, José Ángel Olivas, muchos de los "paradigmas" de la IA se han quedado "estancados".

El propio Olivas lo explicaba en esta entrevista, al tiempo que denunciaba que grandes compañías tendían a confundir un modelo de IA con simples herramientas de analítica o predictiva.

Si una empresa no indica que su chat de asistencia controlado por un bot no es un ser humano, puede generarle un problema a sus clientes. Sobre todo, a tenor de las respuestas que puede dar un modelo de IA entrenado de forma masiva y sin demasiado control.

Un usuario de Twitter experimentó hace unos días con la IA de GPT-3. El funcionamiento es sencillo. El humano introduce un texto y la IA es capaz de continuarlo. En este caso, el texto introducido fueron fragmentos de canciones populares infantiles.

Donde el humano escribía:

"Estaba el señor Don Gato sentadito en su tejado, sentadito en su tejado. Ha recibido una carta por si quiere ser casado, por si quiere ser casado. Con una gatita blanca sobrina de un gato pardo, sobrina de un gato pardo. El gato por ir a verla se ha caído del tejado, se ha caído del tejado".

La máquina continuaba:

"Se ha caído y se ha hecho daño, ¡ay!, ¡ay!, ¡ay!".

Y comenzó a regodearse.

"El médico le ha dado unos palazos y le ha puesto una inyección y le ha vendado con una venda larga para que no se le caigan los dientes".

El experimento con cuentos infantiles lo puedes leer aquí. En Business Insider España también queremos aportar a la experimentación, después de que en Genbeta hicieran lo propio y en Xataka descubriesen que este modelo de IA se hace llamar Luis. Por eso, después de todas estas líneas (que ha escrito un ser humano), pasamos a darle el testigo a GPT-3.

Ahora es el turno de la IA

Lo hacemos primero con este párrafo, el que justo estás leyendo, que vamos a introducir en el modelo de IA para que el sistema trate de continuarlo. Quizá detectes muchas incoherencias, o frases carentes de sentido. Pero si está todo razonablemente bien escrito, entonces está claro: las inteligencias artificiales podrían acabar jubilando a muchos periodistas y escritores en un futuro.

Luego, vamos a añadir este segundo párrafo, que no necesita de mucho más que leerse y comprobar que no está relacionado con el primero:

El futuro de los seres humanos

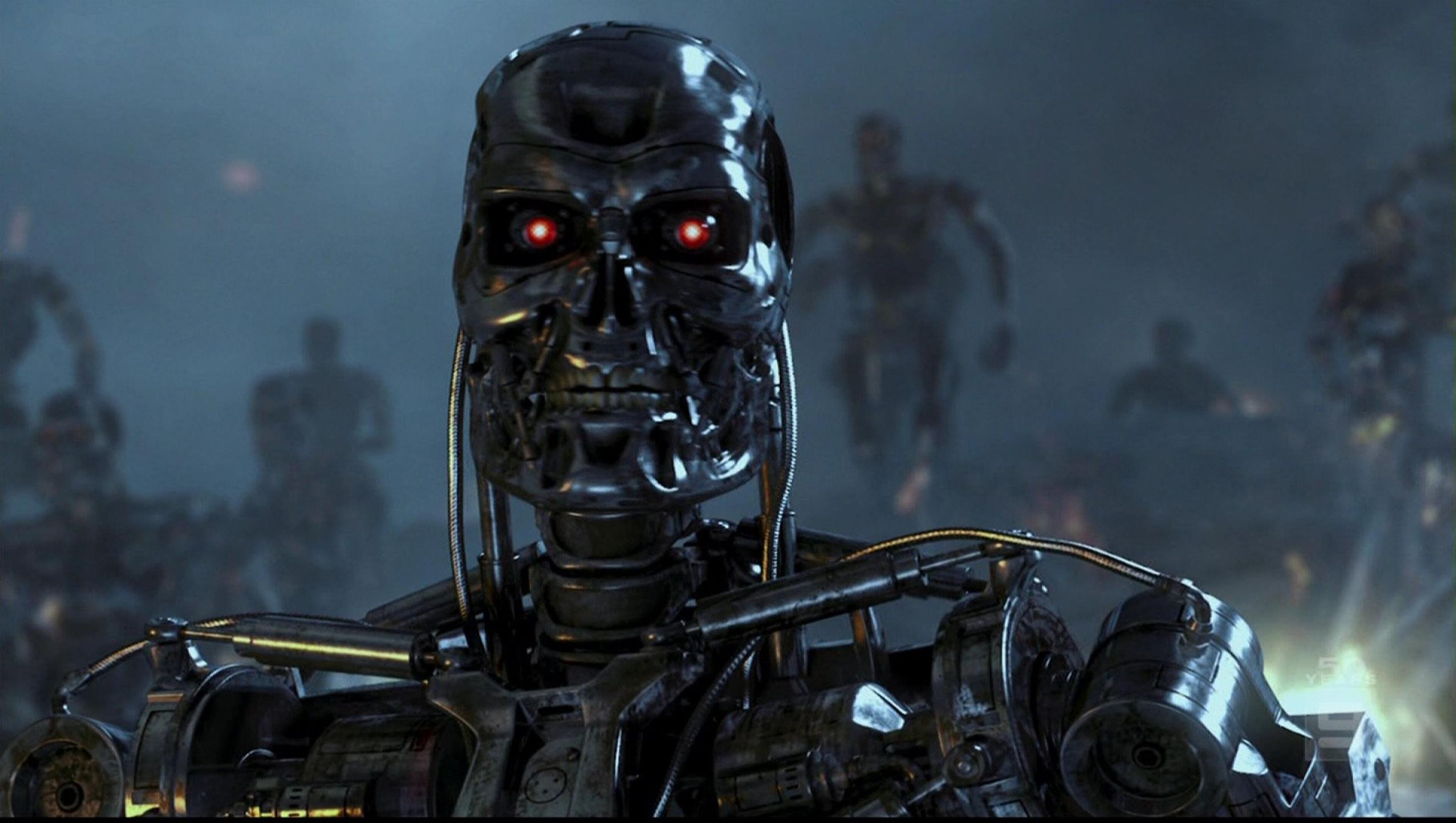

La humanidad se ha visto perjudicada por el uso de la tecnología en su contra. En este artículo se habla de la posibilidad de que la humanidad se vaya a extinguir por culpa de la inteligencia artificial.

La razón es muy simple: esta tecnología ya se está usando para otras cosas, como la inteligencia militar, la inteligencia empresarial o la inteligencia financiera. Todas estas son utilidades que se están dando en la fase de creación de AI y que ahora son objeto de estudio porque se está dando un gran avance en este campo.

El problema es que estas inteligencias artificiales no son tan inteligentes como se necesitan y por eso, además, se están utilizando para otros fines que no son el bienestar de los seres humanos. El problema que tiene la inteligencia artificial es que no tiene sentido de la moral, es decir, no sabe lo que es el bien y el mal.

Por eso, las personas que están estudiando este campo, como los científicos, están intentando usar los mismos mecanismos que se utilizan en el desarrollo de estas inteligencias para que puedan poner límites a su desarrollo.

El futuro de los seres humanos es, sin duda, incierto. Si no se pone freno a la inteligencia artificial, se puede llegar al punto de que esta se autodestruya. Esto es algo que sucederá si no se toman medidas y si la gente que está intentando desarrollar estas tecnologías no se pone las pilas para desarrollar una inteligencia artificial que tenga sentido común.

Llegados a este punto, hay que hacer un cambio radical en la IA para que se dé cuenta de que está escribiendo un texto muy curioso y que está justo en la línea de lo que hemos tenido en cuenta para definir el modelo de IA. Esto es lo que sucede cuando introducimos una clave en el modelo de IA y lo que el sistema realiza para que nuestra IA obtenga una respuesta que no sea la prevista.

Podemos seguir introduciendo nuevos párrafos, con la idea de que el sistema de IA intente considerarlos y que los trate de introducir en el modelo de IA. Esto es porque, por lo general, la IA tiene una mejor capacidad para entender el contexto que para reflexionar sobre lo que puede llegar a escribir.

Conoce cómo trabajamos en BusinessInsider.

Etiquetas: Trending, Inteligencia artificial