El proyecto de la Comisión Europea para regular la inteligencia artificial vigila su uso en hospitales, pero deja libertad a los ejércitos

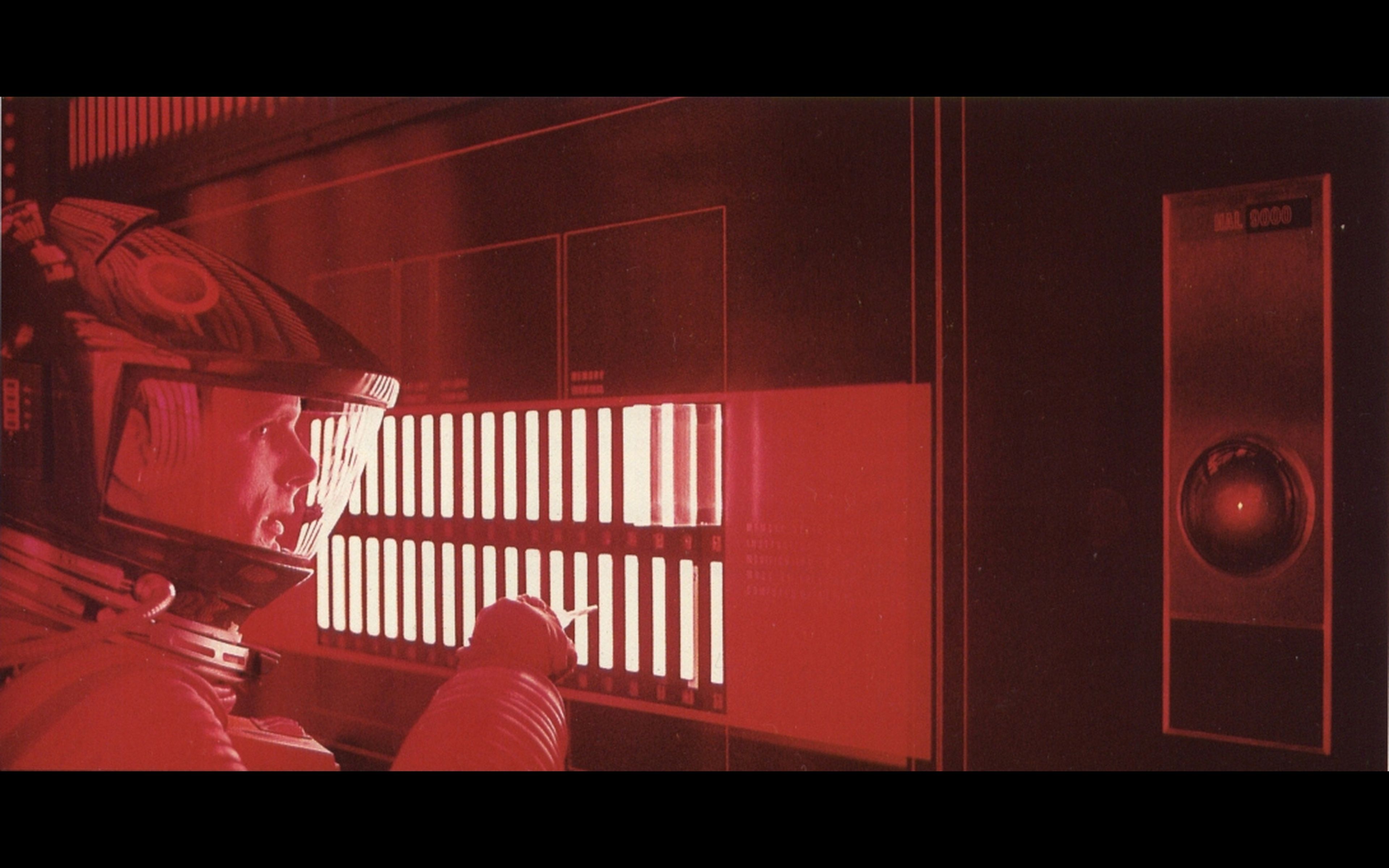

Metro-Goldwyn-Mayer

- La Comisión Europea ha publicado un proyecto para regular la inteligencia artificial y sus usos, pero no se aplicará explícitamente a los ejércitos en este sentido.

- Esto contrasta con la descripción de los proyectos que este marco de regulación prohíbe.

- Descubre más historias en Business Insider España.

La inteligencia artificial y los robots son la imagen de un futuro cada vez más cercano, y que llega a pasos agigantados. Sin embargo, para poder disfrutar de una tecnología que tiene tantas implicaciones éticas y morales, es necesaria una regulación que, al menos, enmarque el desarrollo y el uso que se le puede dar a esta.

La Comisión Europea ha presentado un marco regulatorio de los más completo que puede tener grandes implicaciones en el desarrollo de la inteligencia artificial y en su carácter humanista. Algo que ya tiene precedentes en Europa, ya que en años anteriores, la Comisión ha presentado una serie de estrategias y planes hablando sobre este tipo de tecnologías.

En primer lugar, se establece que la inteligencia artificial no debe ser un fin, sino una herramienta que debe servir a las personas y contribuir a aumentar su bienestar, y por ello, la normativa referente a esta debe poner en el centro del tablero al ser humano, respetando sus derechos fundamentales. Sin embargo, llama la atención la manera en la que los ejércitos emplean la Inteligencia Artificial.

"Al mismo tiempo, estas reglas para la inteligencia artificial deben ser equilibradas, proporcionadas y no limitar ni obstaculizar innecesariamente el desarrollo tecnológico. Esto es de particular importancia porque, aunque la inteligencia artificial ya está presente en muchos aspectos de la vida diaria de las personas, no es posible anticipar todos los posibles usos o aplicaciones de la misma que puedan ocurrir en el futuro", afirma la Comisión en el proyecto.

Los 20 delitos más peligrosos que va a crear la inteligencia artificial en el futuro.

La inteligencia artificial ya está muy presente en el día a día de casi cualquier persona, y es que esta no solo se incluye en los asistentes virtuales como Siri, Google Assistant o Alexa, sino también en los algoritmos presentes en las redes sociales e incluso en plataformas de streaming que son capaces de recomendarte contenido en función de los títulos que te han gustado.

Se trata de una tecnología que hay que tener presente, en especial de cara al futuro, y Europa quiere actuar para asegurar que los usos que se le da a esta sean correctos y no vayan en contra del interés del ser humano. Pese a que haya corrientes de pensamiento que opinen que se producirá una "rebelión de las máquinas" en algún momento, en la regulación está la solución.

Las investigaciones con Inteligencia Artificial deberán clasificarse según su nivel de riesgo, y hay algunas que estarán prohibidas

Este proyecto de marco regulatorio recoge diferentes ideas para lograr una regulación efectiva, comenzando por dividir los diferentes proyectos relacionados con la IA en cuatro niveles de riesgo diferentes en función del daño que estos podrían hacer a la sociedad.

- Riesgo mínimo: usos cuyo propósito sea legal y no suponga ningún riesgo, como los videojuegos.

- Riesgo limitado: el desarrollador deberá informar al usuario por adelantado de la presencia de la inteligencia artificial. No hay restricciones especiales.

- Alto riesgo: cuando la IA sea utilizada como un componente de seguridad. Pueden llegar al mercado, pero estarán sujetos a estrictos requisitos.

- Totalmente prohibido: cualquiera que vulnere los derechos fundamentales y que suponga un claro peligro para la vida de la gente.

Para poder llevar a cabo diferentes proyectos en condiciones reales, pero que no generen consecuencias reales, se utilizarán sandbox que aseguren la seguridad de los mismos. Al fin y al cabo, la capacidad transformadora de la IA son muy grandes.

Sin embargo, llama la atención que estas normas no se aplicarían a las investigaciones y proyectos realizados por los ejércitos, destinados a servir en proyectos militares, o al menos no se recoge en el marco regulador. Sin embargo, un robot cirujano con una inteligencia artificial desarrollado por una empresa de salud sí que requeriría de una supervisión y vigilancia.

Por el momento, el marco regulatorio es un proyecto, y para que este se materialice tendrá que superar un proceso parlamentario que, si discurre con éxito, desembocará en la ratificación y publicación del mismo, lo cual podría tener implicaciones globales.

Conoce cómo trabajamos en BusinessInsider.

Etiquetas: Tecnología