Facebook tiene un sistema interno que permite a 5,8 millones de políticos y famosos incumplir las normas de la plataforma

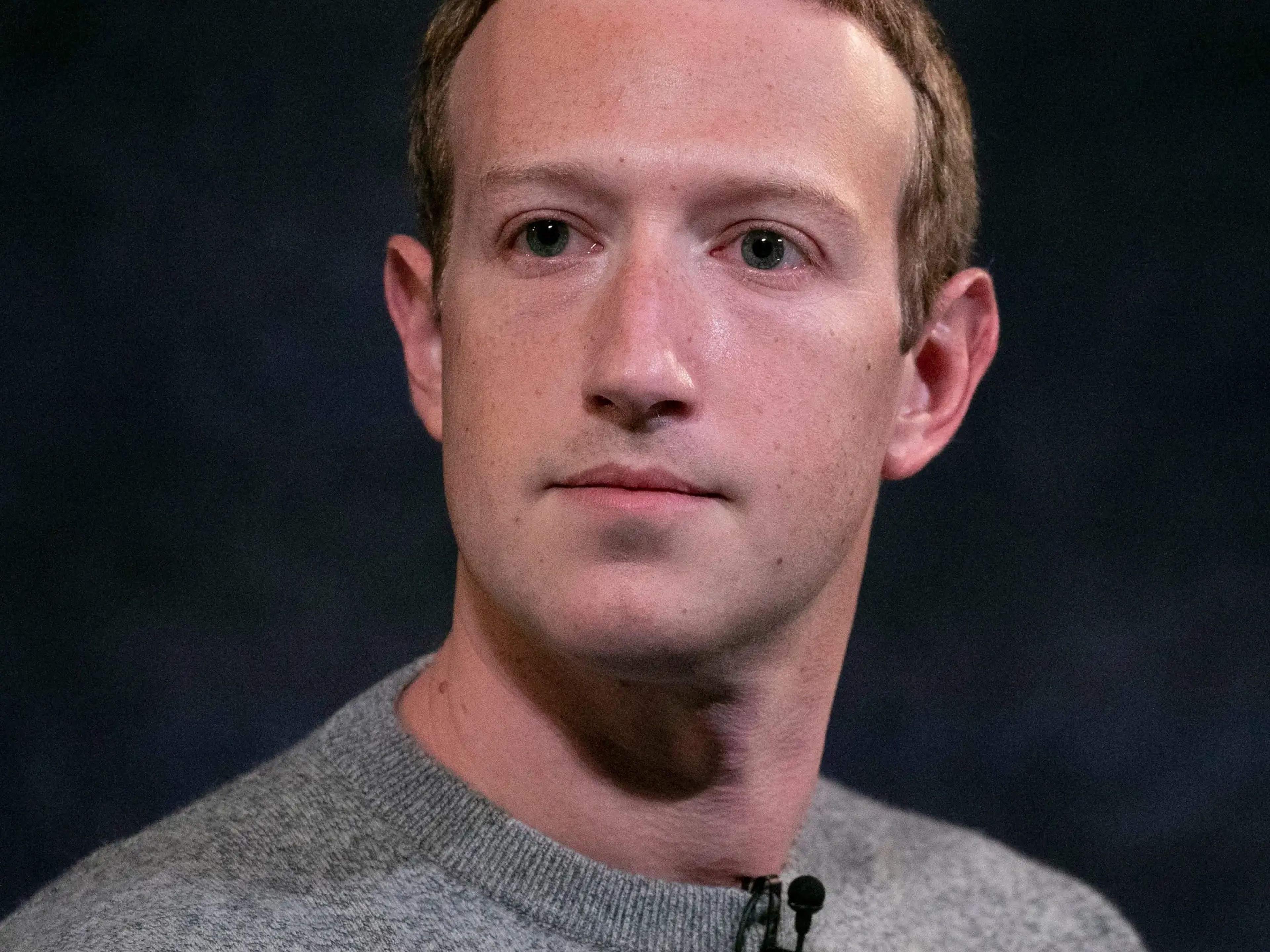

AP Photo/Mark Lennihan

- Facebook tiene un sistema que protege a determinados usuarios VIP si violan las reglas de contenido de la red social, según The Wall Street Journal.

- El sistema XCheck ha protegido a personas como Donald Trump, el futbolista Neymar y otras figuras "influyentes".

- Los empleados de Facebook han mostrado su desacuerdo por dar un trato especial a los usuarios.

- Descubre más historias en Business Insider España.

Facebook cuenta con un sistema interno que permite a 5,8 millones de usuarios evitar tener que seguir las reglas de su plataforma, según Wall Street Journal.

El periódico ha publicado este lunes una investigación que detalla cómo los usuarios de alto perfil que son "de interés periodístico, influyentes o populares" no tienen que cumplir las normas de Facebook que sí deben seguir los usuarios normales, citando varios documentos internos de Facebook.

Un exempleado de Facebook cuenta que la compañía "hace excepciones de manera rutinaria para las figuras relevantes", según el WSJ.

Personas como Donald Trump, la estrella de fútbol Neymar Jr., la senadora Elizabeth Warren e incluso Doug the Pug están cubiertos por el sistema al que se le conoce como XCheck o verificación cruzada.

El sistema se creó en respuesta a las deficiencias de los procesos duales de moderación humana y de inteligencia artificial de Facebook.

Este sistema XCheck ha provocado un montón de problemas de todo tipo. Cuando aparecen nuevos usuarios es más difícil que los moderadores tomen medidas contra estas personas.

Neymar, por ejemplo, publicó en WhatsApp una imagen de una mujer desnuda en donde se mostraba su nombre y esta lo acusó de violar las reglas.

Al compartir "imágenes íntimas no consensuadas", esto habría llevado a Neymar a eliminar la publicación, pero como está cubierto por XCheck, los moderadores no pudieron eliminar el contenido. Varias imágenes que luego fueron vistas por 56 millones de usuarios.

Se revisa menos del 10% del contenido de XCheck. Andy Stone, portavoz de Facebook, comenta al Journal que ese número ha crecido en 2020, pero no ha proporcionado ningún dato para respaldar esta afirmación.

La mayoría de empleados de Facebook pueden agregar usuarios al sistema XCheck, en donde están esas cuentas de alto perfil que no deben seguir las reglas. El Wall Street Journal reveló en 2019 que Facebook no siempre lleva un registro de quienes están en este tipo de listas blancas, algo que plantea "numerosos riesgos legales, de cumplimiento y de legitimidad para la empresa y daños a nuestra comunidad".

Los empleados de Facebook, incluido un ejecutivo que dirigió su equipo cívico, han expresado su desaprobación por la práctica de Facebook de otorgar un trato de favor a algunos usuarios y dicen que no está alineada con los valores de la compañía.

"Tener diferentes reglas sobre el habla para diferentes personas es muy preocupante para mí", escribe un empleado en una nota recogida por el WSJ. Otro empleado también dijo que Facebook está "influenciado por consideraciones políticas" al tomar decisiones de moderación de contenido, informó el diario.

Facebook reconoció que existía XCheck y le ha contado al WSJ que está tratando de cerrar estas listas blancas.

Los documentos de la empresa también muestran la intención de Facebook de erradicar el sistema: un gerente de producto propuso un plan para dejar de permitir que los empleados de Facebook agreguen nuevos usuarios.

Algunos de los documentos de la compañía se entregarán a la Comisión de Bolsa y Valores y al Congreso, y esa persona solicitará protección federal como denunciante, según el WSJ.

En una serie de tuits, Andy Stone, director de comunicación de Facebook, mostró su sistema de verificación cruzada en 2018 después de que Channel 4Newspreguntase por la práctica.

"Al final, en el centro de esta historia está el propio análisis de Facebook de que necesitamos mejorar el programa", tuiteó Stone. "Sabemos que nuestra aplicación no es perfecta y que existen compensaciones entre velocidad y precisión".

Zuckerberg ha promocionado durante mucho tiempo que no quieren que la plataforma sea "un árbitro de la verdad" o que decida qué es verdadero o falso y luego deje o elimine el contenido en consecuencia.

Sin embargo, ese enfoque de no intervención ha colocado a Facebook en una posición incómoda, sobre todo en los últimos años, ya que los críticos dicen que la información errónea corre desenfrenada en la red social y algunos republicanos hacen una cruzada contra la compañía por cumplir una agenda liberal y discriminar a los conservadores en línea.

Facebook ha implementado varios elementos tras este escrutinio: en junio surgieron varios informes que revelan que Facebook dejará de otorgar un trato especial a los políticos y deberán cumplir las reglas de contenido.

Facebook no ha hecho ningún comentario a las preguntas de Business Insider.

Conoce cómo trabajamos en BusinessInsider.

Etiquetas: TrendingRedes Sociales, Facebook