El "padre de Internet" dice que la reacción de los empleados de Google a la colaboración de la tecnológica con el ejército se debió a "un gran malentendido"

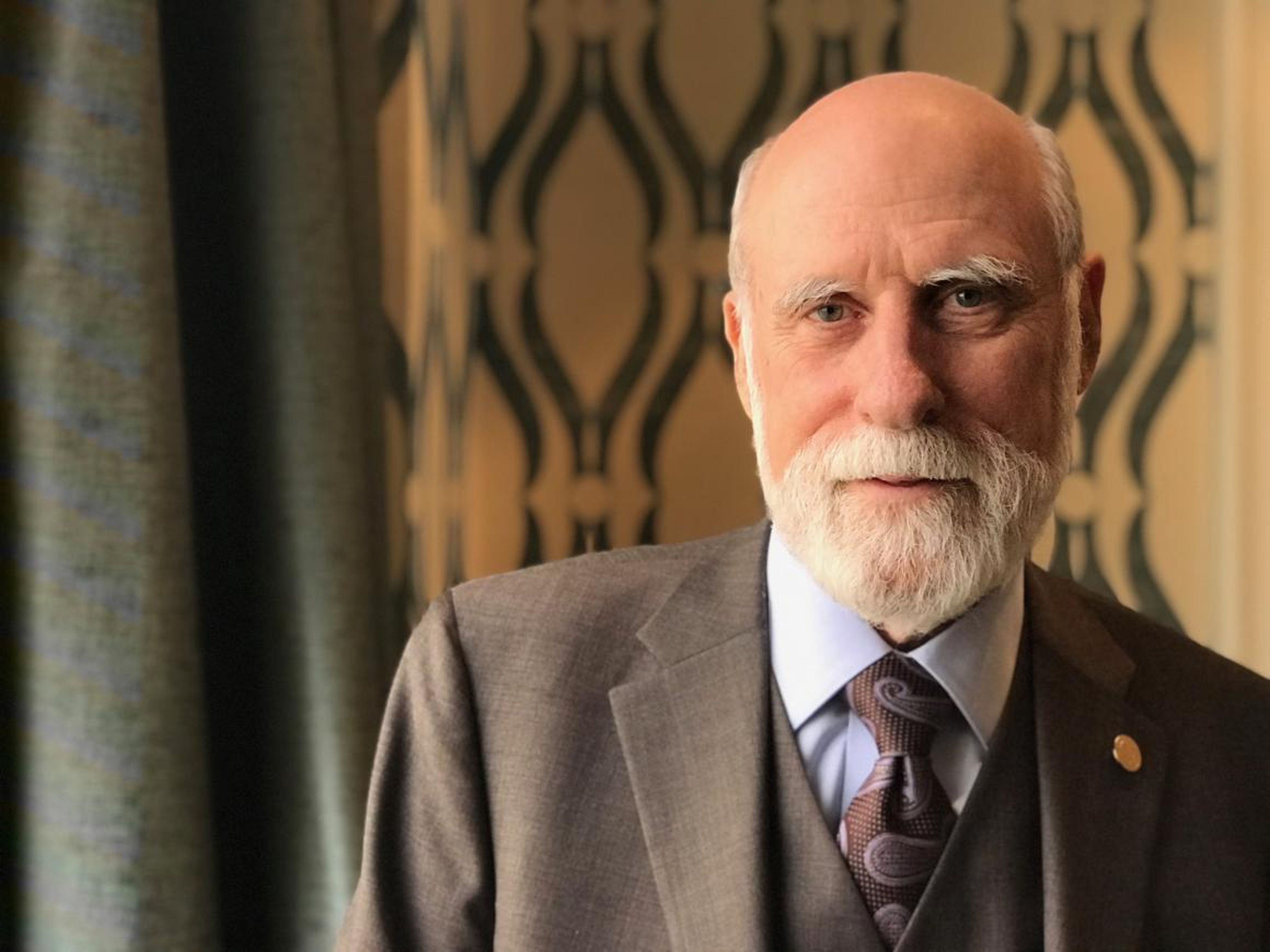

- Vint Cerf, uno de los padres de Internet, defendió esta semana el trabajo de Google en el Proyecto Maven, su controvertido programa piloto con el Pentágono.

- Las objeciones de los empleados al trabajo, que involucraba el desarrollo de tecnologías de inteligencia artificial para uso del Departamento de Defensa, se basaron en un malentendido sobre la naturaleza del trabajo, dice Cerf, que es el principal evangelista de internet de Google.

- Pero la compañía podría haber sido más transparente sobre lo que estaba haciendo, reconoce.

Si le preguntas a Vint Cerf, las protestas en Google sobre su contrato para ayudar a desarrollar tecnologías de inteligencia artificial para el ejército pueden atribuirse a un malentendido.

Los empleados que se opusieron al trabajo de la compañía para el Departamento de Defensa no entendieron realmente la naturaleza del trabajo o sus beneficios, dice Cerf, vicepresidente del gigante de las búsquedas y principal evangelista de Internet, a Business Insider esta semana en la conferencia de Our People-Centered Digital Future en San José.

Aunque algunos empleados de Google expresaron su preocupación de que la tecnología podría ser utilizada por los militares para matar gente, no se trata de eso, asegura.

"La gente estaba llegando a conclusiones sobre el propósito de esos contratos y los objetivos de los contratos que no creo que estén justificadas", dice Cerf, presidente de la coalición People Centered Internet, que ayudó a organizar la conferencia. PCI es un grupo internacional dedicado a garantizar "que Internet continúe mejorando la vida y los medios de vida de las personas y que Internet sea una fuerza positiva para el bien".

Un contrato en silencio llevó a protestas masivas

Cuando los empleados se enteraron del lo que ocurría en febrero, muchos de ellos se indignaron. Muchos expresaron su preocupación de que incluso si la tecnología no fue desarrollada inicialmente para propósitos letales, eventualmente podría usarse para eso. Más de 4.000 firmaron una carta exigiendo que la compañía cancelara el contrato y prometiera nunca construir "tecnología de guerra". Cerca de una docena también dimitió en protesta por ello.

La compañía anunció en junio que no renovaría el contrato cuando expire el próximo año, y el CEO de la compañía, Sundar Pichai, anunció una serie de principios que guiarían su desarrollo y aplicaciones de AI. Entre otras cosas, dijo que la compañía no "diseñaría o desplegaría" una inteligencia artificial que se pudiera usar para armas o para vigilancia ilegítima

Leer más: Google rectifica y promete que su inteligencia artificial no se utilizará para desarrollar armas

Cerf dijo que el contrato era sobre "conciencia situacional"

Para Cerf, sin embargo, el alboroto fue exagerado. Las preocupaciones de los empleados sobre el uso de la tecnología de inteligencia artificial de Google por parte de los militares en general carecían de fundamento, dice.

Tal como él lo entiende, el propósito del contrato era desarrollar tecnología para detectar automáticamente cosas que podrían ser dañinas, como personas que colocan dispositivos explosivos improvisados. No fue diseñado para detectar y apuntar automáticamente a individuos, asegura.

"Ese proyecto en particular, por lo que sé, no fue para hacer eso. Fue una aplicación de conciencia situacional", dijo Cerf, quien es ampliamente considerado como uno de los padres de Internet, porque ayudó a desarrollar sus protocolos de transferencia de datos subyacentes. . "¿Cómo puedo reconocer lo que está pasando a mi alrededor para protegerme contra [esto] ... ¿puedo descubrir automáticamente cosas que están sucediendo en mi entorno que podrían ser perjudiciales?"

Pero según Gizmodo, que fue el primero en informar sobre el contrato del Proyecto Maven de Google, la compañía esperaba que el esfuerzo condujera a un mayor trabajo con el ejército y con las agencias de inteligencia estadounidenses. Como parte del proyecto, ya se estaba desarrollando un sistema para el ejército que podría usarse para vigilar ciudades enteras, informó Gizmodo.

Leer más: Estos son los 10 mayores exportadores de armas a Arabia Saudí (y España está entre ellos)

Los militares hacen más que ir a la guerra

En términos más generales, dice Cerf, los empleados malinterpretaron la amplitud de la misión militar y los esfuerzos tecnológicos. El Departamento de Defensa hace más que ir a la guerra, señala. Entre otras cosas, el ejército ha ayudado a desarrollar tecnologías que han demostrado tener un valor incalculable en el sector privado, dice, destacando su propio trabajo en los años 70 y 80 en el desarrollo de tecnología de Internet en nombre de la Agencia de Investigación de Proyectos Avanzados de la Defensa.

"Hay muchos malentendidos acerca de los beneficios positivos de trabajar con [y] en el sector público, y los militares son parte de ello", defiende.

Google se negó a dar a conocer su trabajo en el Proyecto Maven y, cuando salió a la luz, minimizó su participación, según las noticias publicadas. La compañía inicialmente le dijo a Gizmodo que su trabajo en el proyecto solo consistía en brindar acceso militar al mismo tipo de herramientas de aprendizaje de código abierto que proporciona a otros clientes corporativos e institucionales de sus servicios en la nube. Sin embargo, la compañía había asignado más de 10 empleados al proyecto y estaba trabajando activamente para personalizar su tecnología de inteligencia artificial para el ejército, según Gizmodo.

Cerf reconoce que Google puede tener cierta responsabilidad en el malentendido de sus empleados.

"Probablemente no hubo suficiente transparencia" dice con respecto a su trabajo en el Proyecto Maven.

Conoce cómo trabajamos en BusinessInsider.

Etiquetas: TrendingGoogle, Estados Unidos