Una batalla que se libra en tu cara: estas apps introducen filtros imperceptibles en tus fotos para engañar a sistemas de reconocimiento facial

- A medida que los sistemas de reconocimiento facial prosperan, también lo hacen apps que añaden filtros a tus fotos para que sean irrastreables por estas IA.

- El reconocimiento facial extrae una serie de datos sobre los rostros de los ciudadanos, pero todavía no se ha abordado su regulación.

- Descubre más historias en Business Insider España.

Es recurrente: cada cierto tiempo se pone de moda una aplicación para móviles que es capaz de jugar con fotos de tu cara.

Desde FaceApp, con la que los usurarios podían ver cómo podría ser su vejez dentro de unos años, y que ya podía ser problemática desde el punto de vista de privacidad; hasta Wombo.ai: te sonará porque las redes sociales se han llenado de imágenes de celebridades moviendo la cabeza y cantando al ritmo de una canción.

Estos divertimentos no son tan inocentes como parecen. El hecho de que para funcionar requieran de una imagen tuya —o de la quien tú quieras— permite a sus sistemas de inteligencia artificial y reconocimiento facial seguir 'entrenándose' para mejorar sus resultados.

Algo que a priori no es negativo, pero: ¿qué pasará si algún día una app como esta utiliza los datos extraídos de tu rostro para fines espurios?

Ya hay incluso plataformas que permiten rastrear la red en busca de imágenes tuyas que hayan sido subidas sin tu consentimiento, precisamente mediante tecnologías de reconocimiento facial. Una de las opciones más populares en este sentido es Clearview AI, que en Estados Unidos ha sido utilizada por las fuerzas del orden y que en Europa se enfrenta a demandas y críticas.

Si proteger tu rostro y tu huella digital en la red es una de tus preocupaciones, estas dos herramientas que analiza la MIT Technology Review son para ti. La revista del prestigioso Instituto Tecnológico de Massachusetts explica en este artículo como Fawkes o LowKey son dos proyectos con propósitos similares, y son también punta de lanza de una gran cantidad de aplicaciones del estilo.

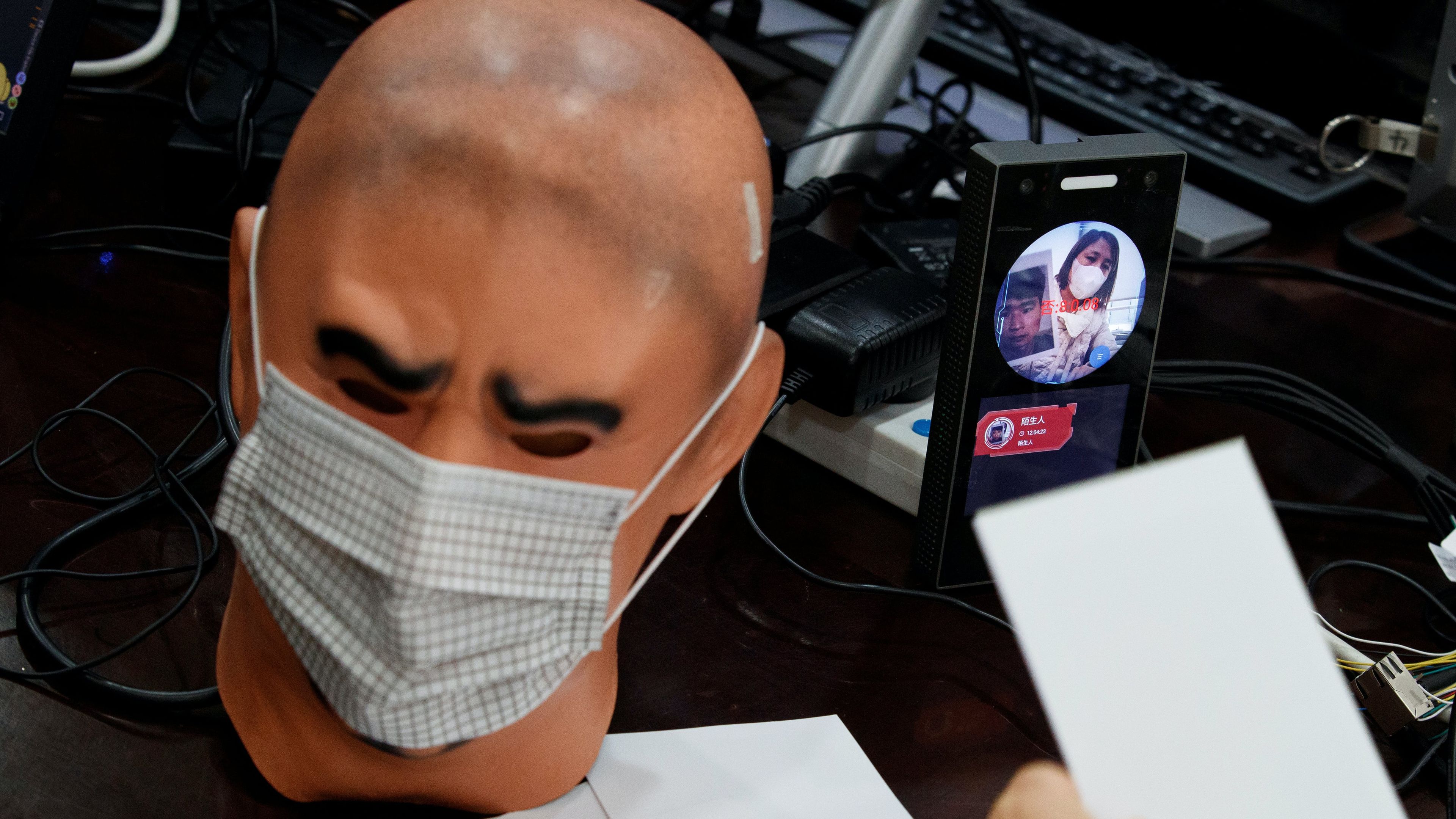

¿Cómo funcionan? Lo que hacen estas aplicaciones es coger una foto tuya y añadirle un filtro imperceptible al ojo humano, pero que puede complicarle mucho las cosas a los sistemas de reconocimiento facial que hay por la red.

"No me gusta que nadie extraiga datos de mí que no tienen por qué tener"

El desarrollo de Fawkes, una de estas herramientas más conocidas, comienza en la Universidad de Chicago. Su responsable es Emily Wenger, que creó junto a varios de sus compañeros esta herramienta el verano pasado. "No me gusta que la gente coja cosas de mí que se suponen que no tienen por qué coger", resume en declaraciones a la MIT Technology Review.

Lo que hace Fawkes es incluir en tus imágenes una serie de perturbaciones en los píxeles que a simple vista son inapreciables. Pero los verdaderos problemas los tendrán sistemas de reconocimiento facial que están presentes en plataformas sociales como Facebook (así es cómo las redes sociales sugieren etiquetarte en fotos).

Cómo borrar datos los de FaceApp de forma fácil y rápida

La publicación estadounidense hace una analogía entre Fawkes y lo que se conoce como un ataque adversario al uso. Este tipo de ataques se emplean para hacer que los modelos de aprendizaje automático con los que pueden funcionar los sistemas de reconocimiento facial caigan en errores graves o sean incapaces de detectar, analizar o comparar el rostro de un ser humano en una foto.

Fawkes ya ha sido probado en un pequeño experimento realizado con 50 imágenes y con algunos de los sistemas de reconocimiento facial ya comercializados más populares, como el AWS Rekognition de Amazon Web Services, el sistema de Microsoft Azure o Face++, una marca desarrollada por Megvii Technology, una pequeña firma china.

La eficacia fue del 100%.

Una oleada de apps para combatir el reconocimiento facial

Para entender lo asumido que está el uso de reconocimiento facial y otros sistemas de inteligencia artificial con las imágenes que compartimos y subimos diariamente a nuestras redes, basta recordar cómo un fallo en la red social por antonomasia a mediados del 2019 reveló cómo su IA etiquetaba a gente en las imágenes.

Fawkes, la herramienta más popular de las que se conocen que se dedican a combatir estas extracciones de datos, ya ha sido descargada de su página web más de medio millón de veces. Un usuario ha creado una herramienta análoga que es completamente en línea, aunque Wenger advierte que ellos no tienen nada que ver y no recomienda su uso, al ser un código editado por un tercero.

En sus propias palabras: "No sabes qué está pasando con tus datos si esa persona los procesa". Aunque Fawkes todavía no cuenta con una versión para móviles, nadie impide que otra persona se encargue de desarrollarla, matiza la investigadora de Chicago.

Son varias las apps del estilo que se están popularizando. La publicación del MIT recoge el caso de LowKey, una herramienta que va algo más allá que Fawkes. Mientras que Fawkes lo que hace es engañar al sistema de reconocimiento facial para que asuma datos que no son reales ni auténticos de tu foto, lo que hace LowKey es crear imágenes que son inabarcables para estos mismos sistemas.

"Fawkes hace que un sistema aprenda algo erróneo sobre ti. Esta herramienta hace que un sistema no aprenda absolutamente nada sobre ti", detalla Wenger, que felicita a los desarrolladores que se han encargado de LowKey.

Una batalla que acaba de empezar

Aun con todo, Wenger avanza a la revista del MIT que el sistema de reconocimiento facial de Microsoft Azure ya es capaz de sortear los filtros de Fawkes. "De repente el sistema se ha vuelto más robusto ante las imágenes que generábamos. No sabemos qué ha pasado".

O bien Microsoft ha cambiado el algoritmo de su sistema, o bien la IA ha sido capaz de detectar un patrón: que las perturbaciones que hacía Fawkes en las imágenes de sus usuarios eran siempre las mismas, y ha conseguido sortearlas desde hace un tiempo.

Se trata, así, de otra carrera entre el ratón y el gato. Por eso Wenger considera que se debe abordar de una vez la regulación de los sistemas de reconocimiento facial, algo que la propia Unión Europea ya ha planteado tibiamente en la presentación de su regulación sobre la IA en el Viejo Continente.

Wenger cree que esto se resume en la historia de internet. "Compañías como Clearview capitalizan lo que ellos perciben como una fuente gratuita de datos que usar para lo que ellos quieran".

Conoce cómo trabajamos en BusinessInsider.

Etiquetas: Trending, Inteligencia artificial, Aplicaciones, Internet, Reconocimiento Facial