La IA "no tiene emociones ni buenas o malas intenciones": el creador de un robot explica un malentendido con su criatura

- El creador del robot de IA que pareció mirar de reojo ante una pregunta de si se rebelaría contra este ha explicado que es un malentendido.

- Will Jackson comparte que el robot está programado para mirar a los lados cuando piensa las respuestas.

- El vídeo muestra los ojos del robot desviándose hacia un lado después de que un reportero le preguntara si se rebelará contra los humanos.

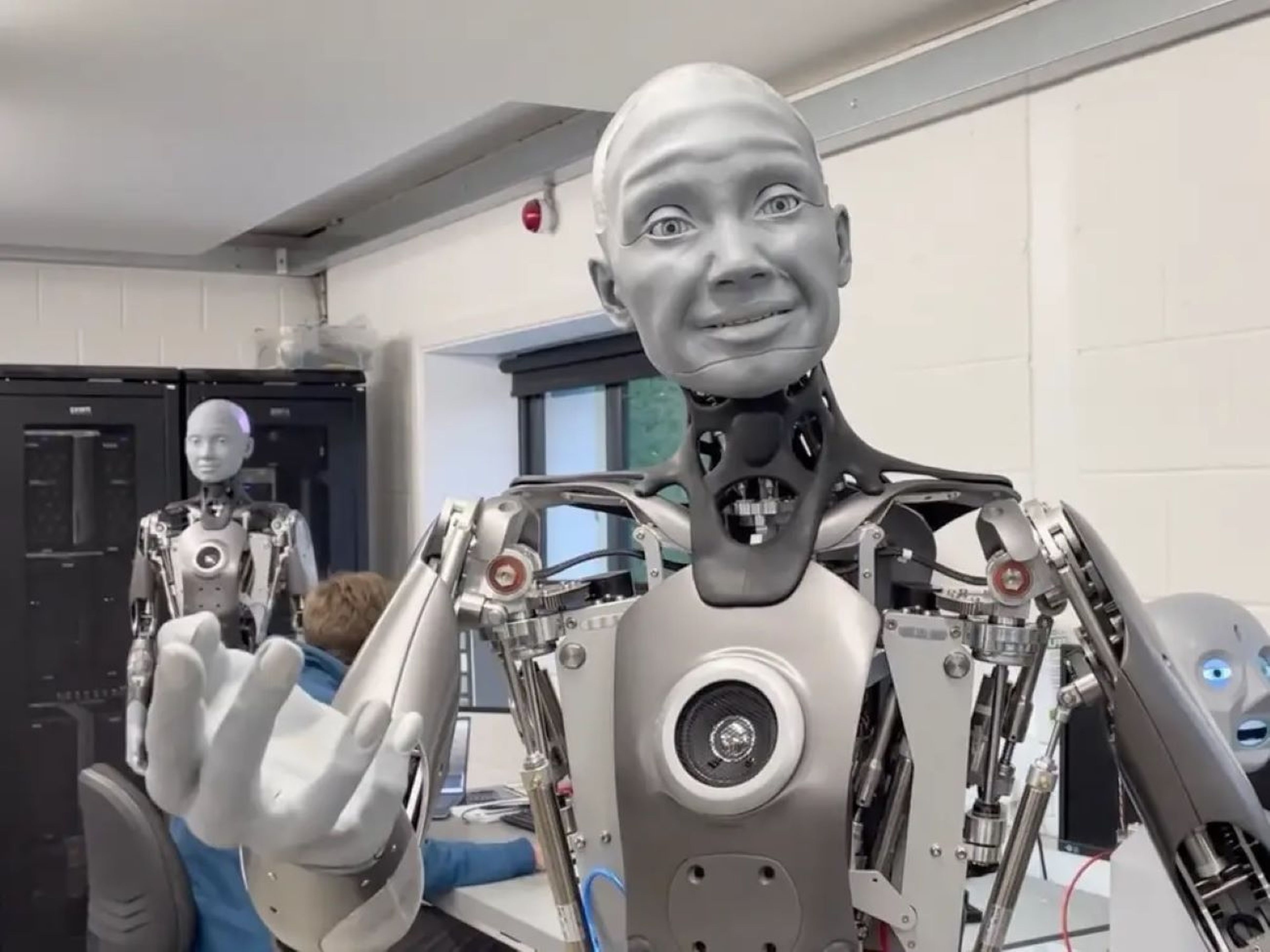

El vídeo de un robot que parece lanzar una mirada de reojo a una pregunta sobre si algún día se rebelaría contra los humanos se hizo viral la semana pasada, pero su creador afirma que todo es un malentendido.

[side-eye, de su original en inglés, es una mirada de soslayo que puede expresar desprecio, sospecha, desaprobación o curiosidad velada; según la RAE, la segunda acepción de 'mirar de reojo' es "mirar con prevención hostil o enfado"]

La semana pasada, un reportero preguntó a un robot humanoide llamado Ameca en la conferencia IA para el bien, de Naciones Unidas, si pensaba algún día "llevar a cabo una rebelión, o rebelarse contra su jefe, su creador". En un vídeo del evento celebrado en Suiza, Ameca pone los ojos en blanco tras la pregunta.

"No estoy seguro de por qué pensarías eso", responde Ameca, tras detenerse un momento y mover rápidamente sus ojos artificiales hacia un lado: "Mi creador no ha sido más que amable conmigo, y estoy muy contento con mi situación actual".

El creador de Ameca, Will Jackson, ha explicado a Business Insider en una declaración enviada por correo electrónico este lunes 10 que el robot no posee la capacidad de expresar emociones, como el sarcasmo, porque está impulsado por el GPT-3 de OpenAI. Fortune ha sido el primer medio que ha informado sobre los comentarios de Jackson.

"Para que la gente no piense que el robot está congelado o que no ha oído la pregunta, lo programamos para que mire hacia la izquierda y rompa el contacto visual con la persona que interactúa. Es un comportamiento habitual en las conversaciones humanas y la gente lo entiende como una señal visual de que el robot está 'pensando'", explica Jackson.

Según Jackson, es probable que la mirada de Ameca se malinterpretara como mirada de reojo porque el robot estaba situado a un nivel inferior y, por tanto, cuando levantaba la vista parecía que seguía manteniendo el contacto visual.

"Los modelos lingüísticos no tienen emociones ni buenas o malas intenciones. Es fácil imaginar que, como el robot parecía escuchar, formar una respuesta y luego hablar, funciona como un humano. No es así", aclara.

El interés y las bromas en torno a la respuesta de Ameca a la pregunta del periodista apuntan a la fascinación de la gente por la idea de un posible "peor escenario" con la IA.

En los últimos meses, varios ejecutivos, entre ellos Sam Altman, CEO de OpenAI, han advertido de que la inteligencia artificial podría suponer un riesgo de "extinción" similar a una guerra nuclear. Otras figuras destacadas del mundo de la tecnología, como Elon Musk y Steve Wozniak, de Apple, han llegado a escribir una carta abierta a principios de año en la que pedían una pausa en el desarrollo de la IA avanzada.

Sin embargo, algunas figuras notables, como el cofundador de Microsoft, Bill Gates, han afirmado que no es la IA en sí lo que supone una amenaza, sino las personas que podrían intentar controlarla. Jackson ha declarado a Business Insider que considera perjudicial la narrativa sobre los peligros de la IA y que desearía que la gente se centrara más en cómo funcionan los robots.

Otros artículos interesantes:

Conoce cómo trabajamos en Business Insider.