Los 'deepfakes' crecen imparables con el auge de la IA: desde celebridades a contenido sexual de menores de edad

TikTok/Instagram

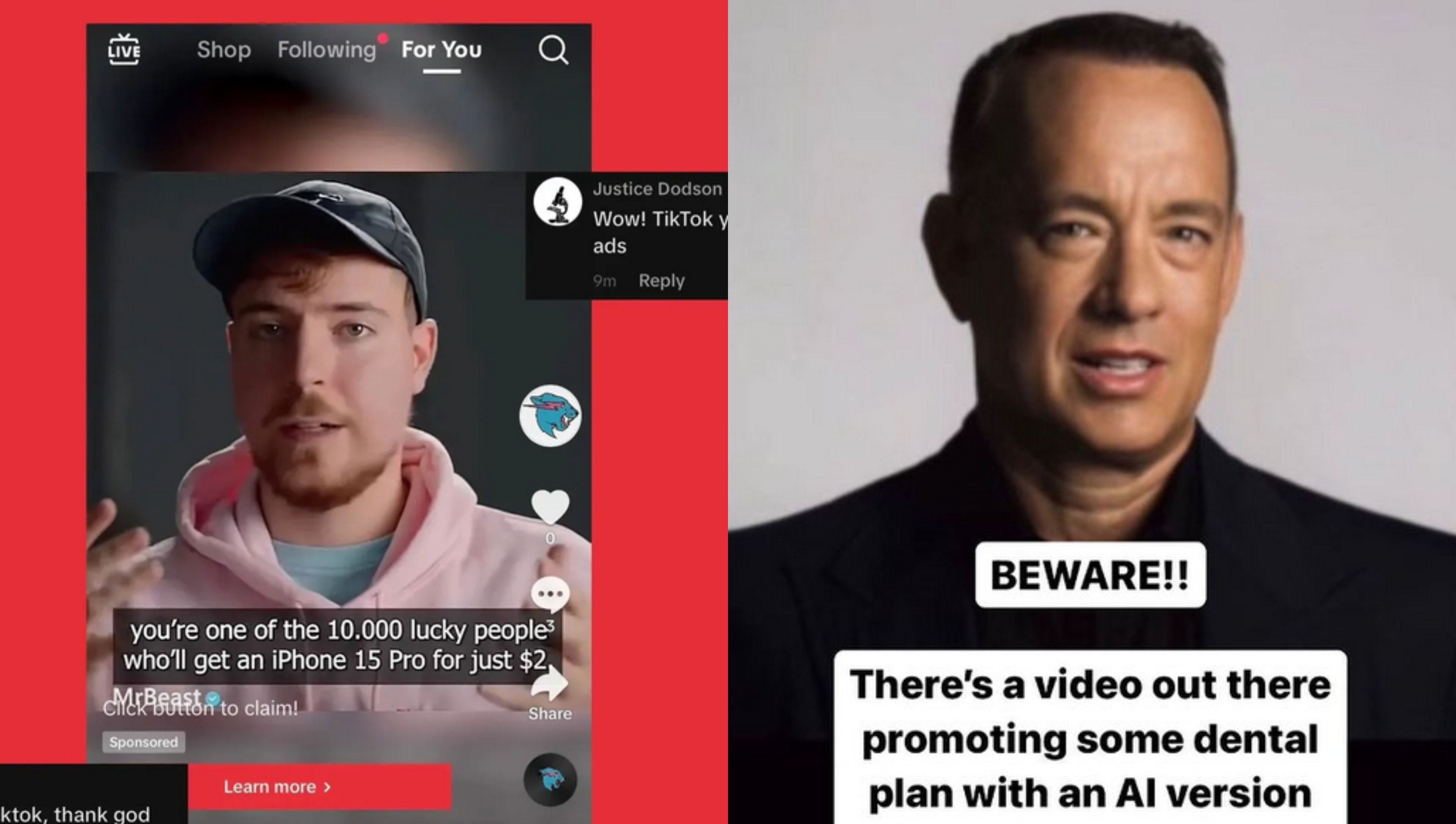

- La IA permite generar imágenes falsas, o deepfakes, desde hace tiempo, aunque con la llegada de herramientas que son capaces de crear fácilmente este tipo de contenido han aumentado los engaños en plataformas como TikTok o Instagram.

- De momento, la Unión Europea continúa desarrollando el Reglamento de IA para imponer sanciones y también existen propuestas de España, para que estos contenidos estén etiquetados claramente.

Numerosas celebridades han tenido que enfrentarse a la proliferación de vídeos en los que aparecían sus imágenes hablando directamente a cámara, pero que habían sido generados con inteligencia artificial.

Son los conocidos como deepfakes, que han afectado a diferentes empresarios, actores e incluso youtubers, como los casos recientes de Tom Hanks o Mr Beast, quienes aparecían promocionando servicios en redes sociales.

Ambos desmintieron que hubieran grabado ningún anuncio y avisaron a sus seguidores en redes sociales y a través de medios de comunicación para que nadie cayera en la trampa.

Con el avance imparable de la IA, el problema se ha hecho más que evidente, ya que por lo general este contenido no está etiquetado como tal, una solución que TikTok ya está planeando introducir en su plataforma.

Así, los deepfakes parecen ir un paso por delante de la legislación: en Bruselas, aún continúan las negociaciones para imponer nuevas sanciones al usar deepfakes sin etiquetas; en España, las propuestas son aún más recientes.

Los diputados de Sumar Enrique Santiago, Francisco Sierra y Tesh Sidi han presentado este mismo viernes en el Congreso una proposición de ley para que la gente pueda reconocer fácilmente los deepfakes en plataformas.

Todo esto a raíz de uno de los casos más evidentes del uso indebido de este tipo de herramientas de IA y que se ha hecho especialmente mediático.

Durante el mes de septiembre, varias niñas de entre 12 y 17 años de Almendralejo (Extremadura) fueron víctimas de la distribución de sus deepfakes, que mostraban contenido sexual y eran difundidos en grupos de WhatsApp.

Miriam Al Adib, ginecóloga, obstetra y divulgadora denunció la distribución de imágenes falsas con contenido sexual de su hija, menor de edad, en diferentes grupos de la plataforma de Meta.

Además de que esto supone un delito, según expresó la propia Al Adib, también implica la necesidad de avanzar rápidamente en la prevención de la difusión de estas imágenes, que afectan a la integridad moral de las personas afectadas.

Otra de las preocupaciones sobre los deepfakes es la proliferación de vídeos generados con intenciones ajenas a la educación, como las imágenes virales de figuras políticas, con el objetivo de desinformar en las redes sociales.

Por eso mismo, ya existen herramientas que son capaces de identificar un deepfake con un margen de error muy bajo, aunque la necesidad de regular este ámbito es más que evidente, para que no vuelva a suceder el terrible caso de Almendralejo.

Otros artículos interesantes:

Descubre más sobre Abraham Andreu, autor/a de este artículo.

Conoce cómo trabajamos en Business Insider.