Este vídeo muestra un choque múltiple de 8 coches después de que un Tesla que supuestamente utilizaba la conducción autónoma se detuviera en un túnel de una autopista

The Intercept reporter Ken Klippenstein on Twitter

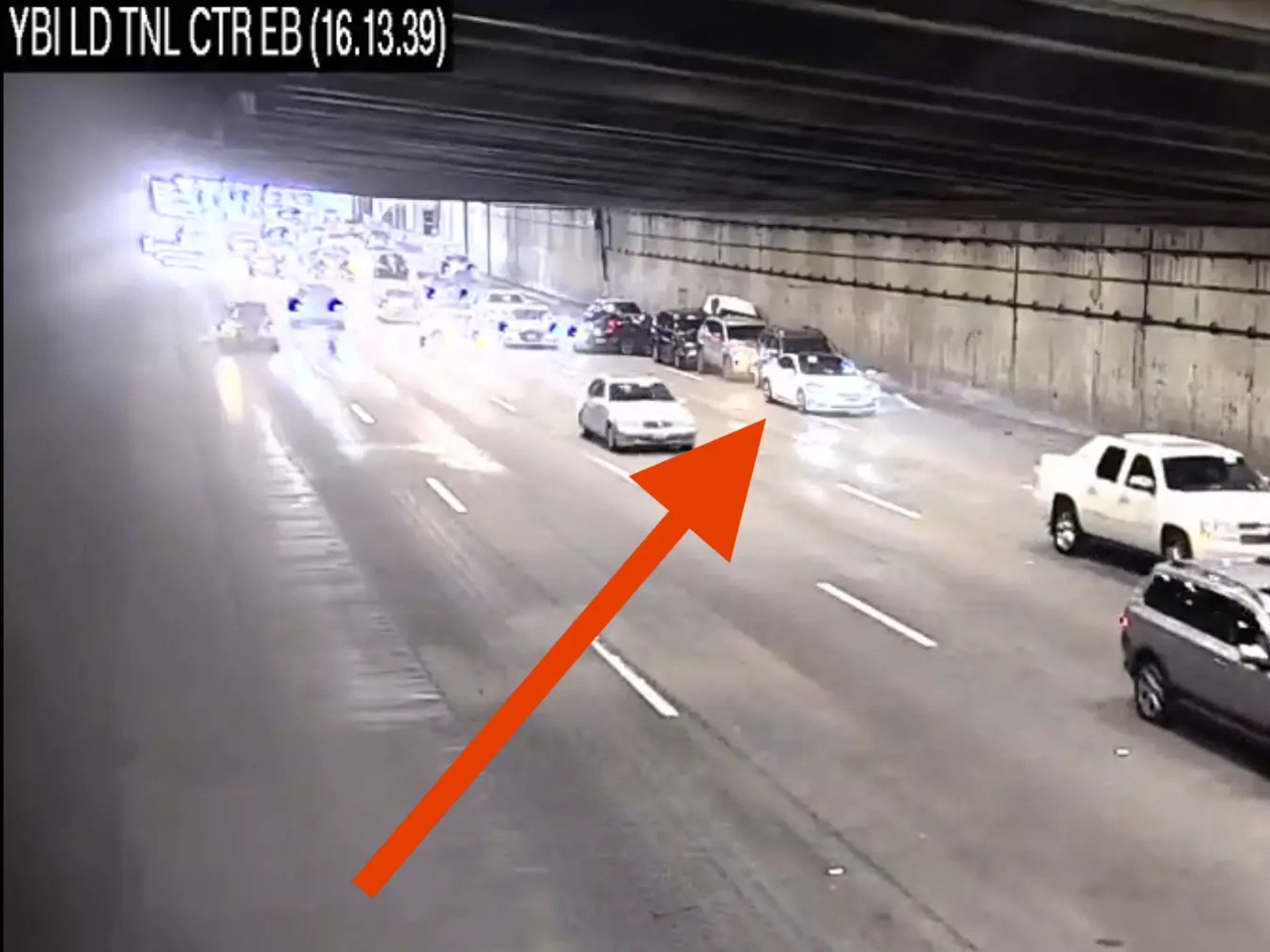

- Un vídeo grabado por una cámara de vigilancia muestra cómo un Tesla se detiene en un túnel de San Francisco y el consiguiente choque múltiple de 8 coches.

- The Intercept ha publicado las imágenes del 24 de noviembre. El conductor del Tesla afirma que en el momento del accidente estaba utilizando el software de conducción autónoma Full Self-Driving.

Las imágenes de vigilancia del puente de la bahía de San Francisco muestran cómo un Tesla se detiene en un túnel de la autopista y provoca una colisión en cadena de 8 coches, según un artículo publicado por The Intercept.

El accidente, ocurrido el 24 de noviembre, interrumpió el tráfico en la carretera durante más de una hora y causó heridas a 9 personas, entre ellas un niño de 2 años. The Intercept ha obtenido 2 vídeos de vigilancia del incidente a través de una solicitud de registros públicos.

En el momento del accidente, el conductor del Tesla explicó a la policía local que el coche había estado bajo la influencia del software de conducción autónoma total Full Self-Driving (FSD) de Tesla y se había desplazado al carril izquierdo y parado justo delante de otro vehículo, según el informe del accidente. Los portavoces de la NHTSA y del Departamento de Transporte de California no han confirmado si la función FSD estaba activada.

El vídeo del periodista de The Intercept, Ken Klippenstein, muestra cómo el Tesla se desplaza hacia el carril izquierdo con el intermitente y se detiene rápidamente delante de otro coche.

El día del accidente, Shayna Kelly, de San Francisco, testigo de los hechos, declaró a KTVU que vio cómo el Tesla se desviaba bruscamente.

"Se detuvo de repente", explica. "En ese momento no había adónde ir".

FSD es un complemento de la función de asistencia al conductor Autopilot de Tesla que permite al vehículo cambiar automáticamente de carril, entrar y salir de autopistas, reconocer señales de stop y semáforos y aparcar. El software está en fase de pruebas beta y aún requiere que un conductor con licencia supervise el sistema en todo momento.

Un portavoz de la National Highway Traffic Safety Administration (NHTSA) ha informado a Business Insider de que la agencia ha abierto una investigación sobre el accidente.

Hasta el 22 de diciembre, la agencia había abierto al menos 41 investigaciones sobre accidentes de Tesla en los que estaban implicadas funciones automatizadas como el frenado automático de emergencia y Autopilot o FSD, según informa CNBC.

Associated Press ha informado de que la NHTSA, como parte de una investigación sobre múltiples accidentes de Tesla, también está revisando un tweet del CEO de Tesla, Elon Musk, en el que el multimillonario afirmaba que planeaba actualizar el software FSD para deshacerse de una función de control del volante para algunos conductores.

El software FSD de Tesla ha sido criticado en el pasado. A lo largo de los años, los probadores de la versión beta han publicado en YouTube ejemplos de fallos en el software, desde frenadas fantasma e intentos de girar hacia el carril equivocado hasta incidentes en los que el software parecía no reconocer a los peatones en la carretera.

El año pasado, el Departamento de Vehículos Motorizados de California acusó a Tesla de prácticas de marketing engañosas en la publicidad de Autopilot y FSD. En 2021, un hombre fue detenido tras ser parado por viajar en el asiento trasero de su Tesla mientras utilizaba la conducción autónoma total.

Conoce cómo trabajamos en BusinessInsider.

Etiquetas: Mobility InsiderTesla, Elon Musk, Coche autónomo, Software