Solo existe un 5% de probabilidades de que la IA acabe con la humanidad, según un estudio en el que han participado 2.700 investigadores especializados

Justin Sullivan/Getty

- Miles de investigadores especializados en inteligencia artificial han compartido sus opiniones acerca del futuro de esta tecnología en un nuevo estudio.

- Casi el 58% de los 2.778 investigadores opinan que la amenaza de extinción de la humanidad por culpa de la IA se sitúa en torno al 5%, aportando así otro argumento al intenso debate que ha marcado la actualidad reciente de Silicon Valley.

En el último año, se ha oído hablar mucho del posible riesgo de que la inteligencia artificial acabe con la humanidad.

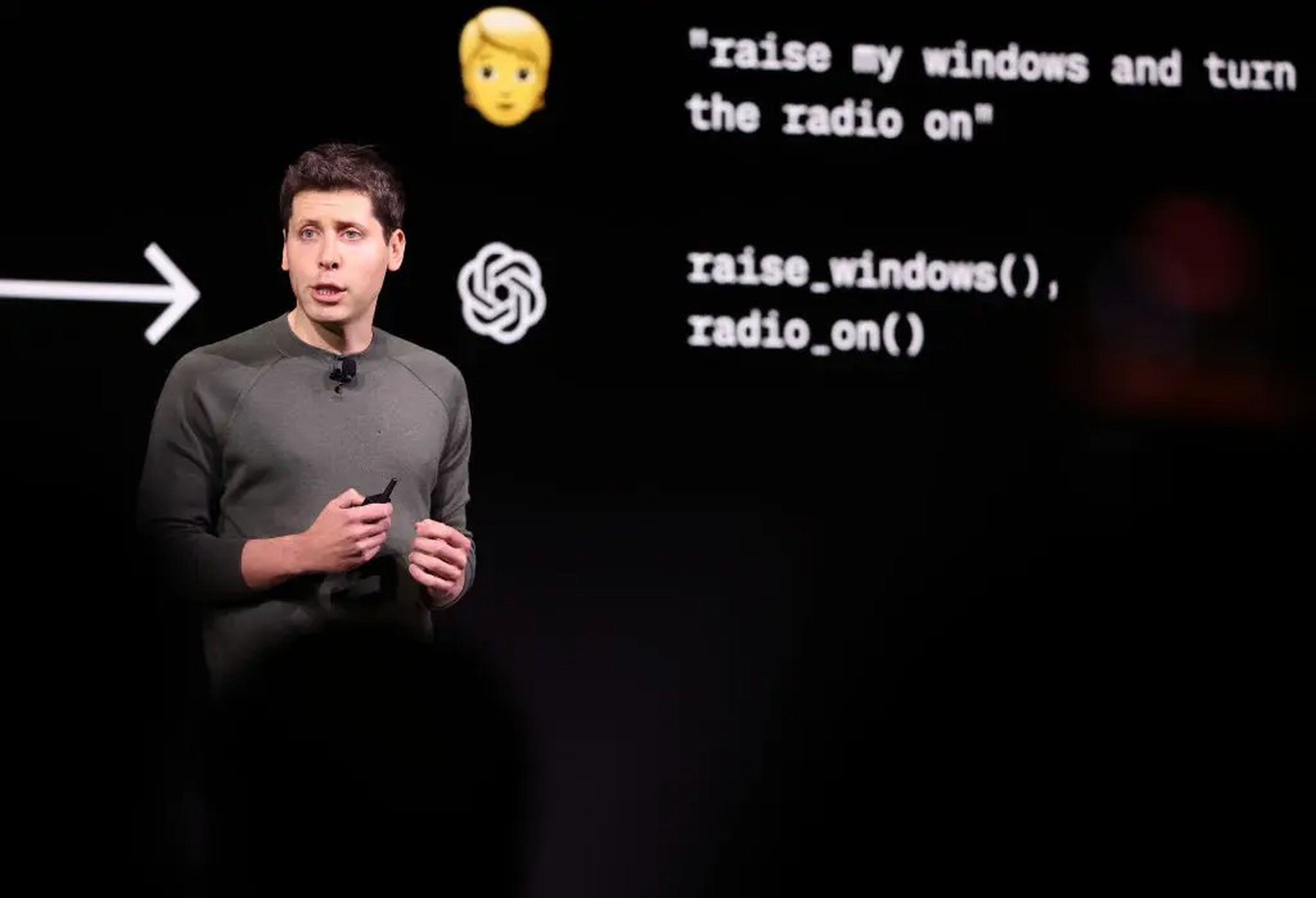

Varios líderes de la industria tecnológica y pesos pesados de la IA han asegurado que el rápido desarrollo de esta tecnología podría tener consecuencias catastróficas para el mundo.

Pero, aunque la mayoría de los investigadores especializados en inteligencia artificial reconocen la posibilidad de una amenaza existencial, no creen que un resultado final dramático sea especialmente probable, según ha revelado la mayor encuesta realizada entre investigadores de IA.

En dicha consulta, se preguntó a los 2.778 participantes sobre las consecuencias sociales de los avances de la inteligencia artificial y los posibles horizontes temporales que se barajan para el futuro de esta tecnología.

Cerca del 58% de los encuestados considera que la amenaza de extinción humana u otras consecuencias extremadamente negativas de la tecnología se sitúa en torno al 5%.

El informe ha sido publicado por investigadores y académicos de universidades de todo el mundo, entre ellas las de Oxford (Reino Unido) y Bonn (Alemania).

Una de las autoras del trabajo, Katja Grace, ha declarado a The New Scientist que este estudio ofrece una muestra de que la mayoría de los investigadores de IA "no consideran muy inverosímil que la inteligencia artificial avanzada destruya a la humanidad". Grace ha añadido que existe una "creencia general en un riesgo no minúsculo".

El debate sobre si la IA supone o no una amenaza significativa para la humanidad se ha recrudecido en Silicon Valley en los últimos meses.

Varios expertos en inteligencia artificial, entre ellos el cofundador de Google Brain, Andrew Ng, y uno de los padres fundadores de esta tecnología, Yann LeCun, han descartado algunos de los mayores escenarios catastrofistas. LeCun incluso ha acusado a líderes tecnológicos como Sam Altman, CEO de OpenAI, de tener motivos ocultos para exagerar el miedo a la IA.

LeCun afirmó el pasado mes de octubre que algunas de las principales empresas de inteligencia artificial estaban intentando "capitalizar la regulación" del sector impulsando una dura legislación.

Otros artículos interesantes:

Conoce cómo trabajamos en Business Insider.