De los 'padrinos de la IA' a los novatos del sector: 17 líderes que deberías conocer y lo que dicen sobre el potencial y los desafíos de la tecnología

Meta Platforms/Noah Berger/Associated Press

- El campo de la inteligencia artificial está en pleno auge y concentra miles de millones en inversiones.

- Investigadores, CEO y políticos debaten sobre cómo la IA podría transformar nuestras vidas.

- Estas son 17 de las principales figuras en este campo, y las oportunidades y peligros que auguran.

Las inversiones en IA crecen con rapidez y van camino de alcanzar los 200.000 millones de dólares en 2025 (unos 183.000 millones de euros al tipo de cambio actual), a medida que las empresas se lanzan a apostar por esta tecnología. Sin embargo, el vertiginoso ritmo de desarrollo también hace que muchas personas se pregunten qué implica todo esto para sus vidas.

La gente se pregunta cómo va a cambiar la inteligencia artificial su manera de comunicarse, cómo puede hacer sus vidas más eficientes e incluso si podría llegar a sustituirles en sus puestos de trabajo. Sin embargo, en los últimos meses, importantes líderes empresariales y expertos en la materia han empezado a hablar de los riesgos que puede traer consigo el rápido desarrollo de la IA.

Algunos afirman que la inteligencia artificial supondrá un gran salto en la calidad de vida de las personas. Otros, en cambio, han firmado un manifiesto pidiendo una moratoria en el desarrollo de esta tecnología, han declarado en el Senado de Estados Unidos sobre sus posibles riesgos y han indicado que podría representar un peligro más urgente para el ser humano que el cambio climático.

En resumen, la IA es un tema apasionante y controvertido. Para ayudarte a entender todo este alboroto, Business Insider ha elaborado una lista con algunos de los grandes nombres de este sector y lo que estos expertos opinan acerca de cómo esta tecnología podría moldear el futuro del ser humano.

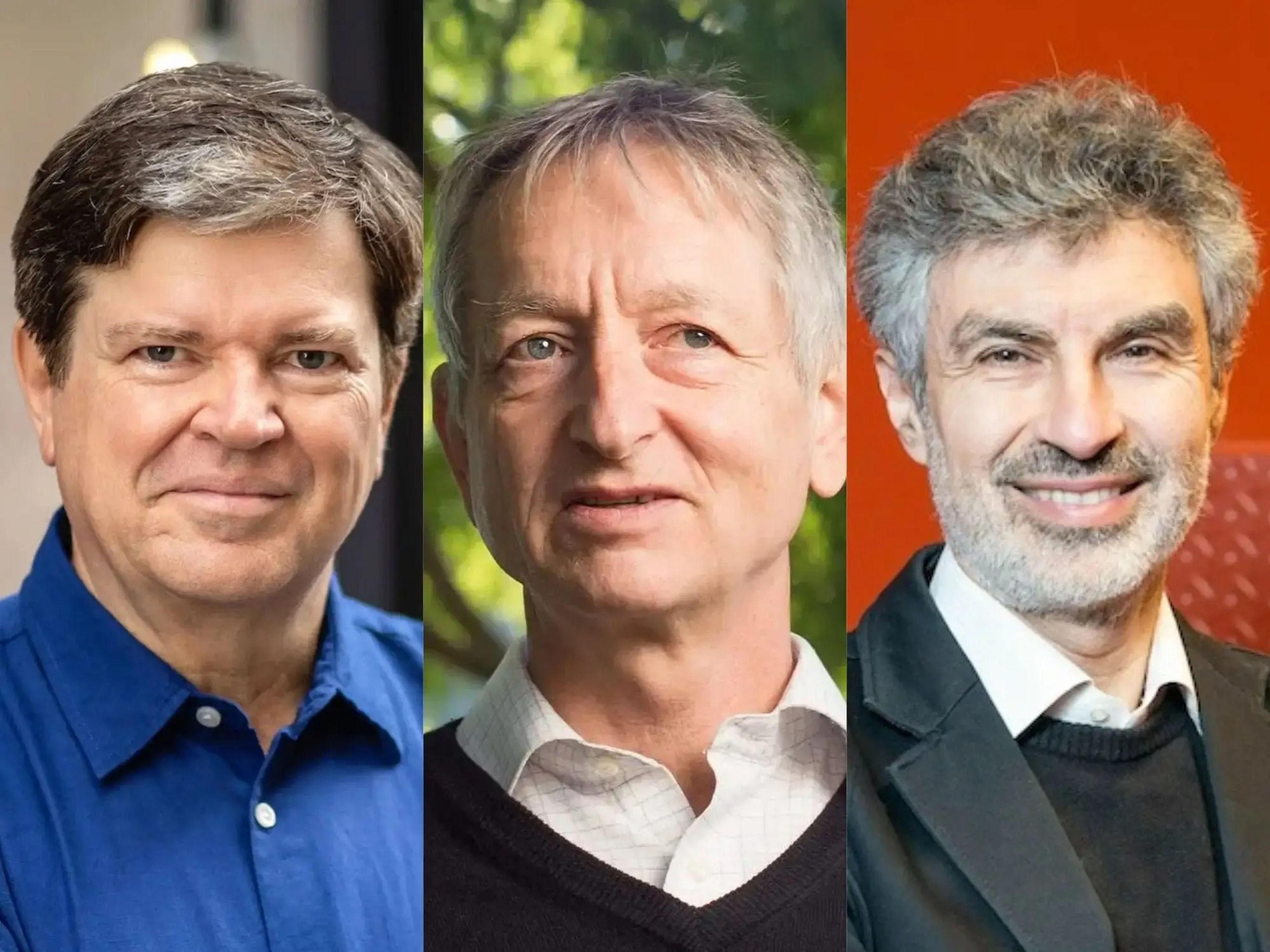

Geoffrey Hinton, profesor emérito de la Universidad de Toronto, conocido como "el padrino de la inteligencia artificial"

Noah Berger/Associated Press

La investigación de Hinton se ha centrado principalmente en las redes neuronales, sistemas que aprenden habilidades analizando datos. En 2018, ganó el Turing Award, un prestigioso premio de ciencias de la computación junto a sus compañeros de investigación, Yann LeCun y Yoshua Bengio.

Hinton también trabajó en Google durante más de una década, pero el año pasado dimitió de su cargo en la compañía tecnológica, según él, para poder hablar con más libertad sobre el desarrollo acelerado de la inteligencia artificial.

Tras renunciar a su empleo, llegó a decir que una parte de él se arrepentía del papel que había desempeñado en el avance de esta tecnología. "Me consuelo con la típica excusa: si no lo hubiese hecho yo, lo habría hecho otro. Es difícil ver cómo se puede evitar que los malos actores la utilicen para hacer cosas malas", declaró Hinton antes de dejar su puesto en Google.

Desde entonces, el investigador se ha convertido en un abierto defensor de la seguridad de la IA y ha calificado esta tecnología como un riesgo para la humanidad más urgente que el cambio climático. También ha firmado un manifiesto que pedía una moratoria de seis meses en el desarrollo de esta tecnología.

Yoshua Bengio es profesor de Informática en la Universidad de Montreal

Associated Press

También se ganó el apodo de "padrino de la IA" tras ganar el Premio Turing junto a Geoffrey Hinton y Yann LeCun.

La investigación de Bengio se centra principalmente en las redes neuronales artificiales, el deep learning —aprendizaje profundo— y el aprendizaje automático. Según su página web, Bengio se convirtió en 2022 en el informático con "el índice h" más alto del mundo, una métrica que se utilizar para evaluar el impacto acumulativo de la producción académica de un autor.

Más allá de su trabajo académico, Bengio también cofundó Element AI, una startup que desarrolla soluciones de software de IA para empresas y que fue adquirida por la compañía de la nube ServiceNow en 2020.

Sin embargo, Bengio también ha expresado su preocupación ante el vertiginoso desarrollo de la inteligencia artificial. El profesor universitario también firmó la carta abierta que pedía una pausa de seis meses en el desarrollo de la IA y que fue firmada por más de 33.000 personas, entre ellas, Hinton, Sam Altman CEO de OpenAI (la desarrolladora de ChatGPT) o Elon Musk.

"Los sistemas actuales ni siquiera están cerca de suponer un riesgo existencial", señaló con anterioridad. "Pero, ¿dentro de uno, dos o cinco años? Hay demasiada incertidumbre".

Sam Altman, CEO de OpenAI, se ha catapultado como una figura importante en el ámbito de la inteligencia artificial desde que publicó ChatGPT

JASON REDMOND/AFP vía Getty

Altman ya era un nombre conocido en Silicon Valley mucho antes de ChatGPT, ya que había sido presidente de la aceleradora de startups Y-Combinator

Aunque el CEO de OpenAI ha defendido los beneficios de la inteligencia artificial, calificándola como el "salto hacia adelante más extraordinario" para la calidad de vida de las personas, también ha hablado con franqueza sobre los riesgos que plantea esta tecnología para la humanidad. Altman ha llegado a declarar ante el Senado estadounidense para abordar la regulación de la IA.

También ha asegurado que los riesgos potenciales de ChatGPT le quitan el sueño.

El informático francés Yann LeCun también fue apodado como "padrino de la IA" tras ganar el Premio Turing con Hinton y Bengio

Meta

LeCun es profesor en la Universidad de Nueva York y también se unió a Meta —la matriz de Facebook, Instagram y WhatsApp— en el 2013, donde ahora es el científico jefe de inteligencia artificial.

En Meta, ha sido pionero en la investigación sobre el entrenamiento de bots para hacer predicciones basadas en vídeos de acontecimientos cotidianos como una manera de dotarlos de una especie de sentido común. La idea es que los humanos aprendemos muchísimo sobre el mundo a partir de la observación pasiva.

A lo largo de su carrera, LeCun ha publicado más de 180 artículos académicos y capítulos de libros sobre temas que van desde el aprendizaje automático hasta la visión artificial y las redes neuronales, según su página web personal.

En comparación con sus compañeros, el profesor universitario se ha mostrado relativamente tranquilo con respecto a los riesgos que plantea la IA. De hecho, ha llegado a decir que la preocupación de que la tecnología pueda suponer una amenaza para la humanidad es "absurdamente ridícula".

También ha afirmado que las herramientas de inteligencia artificial generativa, como ChatGPT, que se han entrenado con grandes modelos lingüísticos todavía no llegan a ser igual de inteligentes que un perro o un gato.

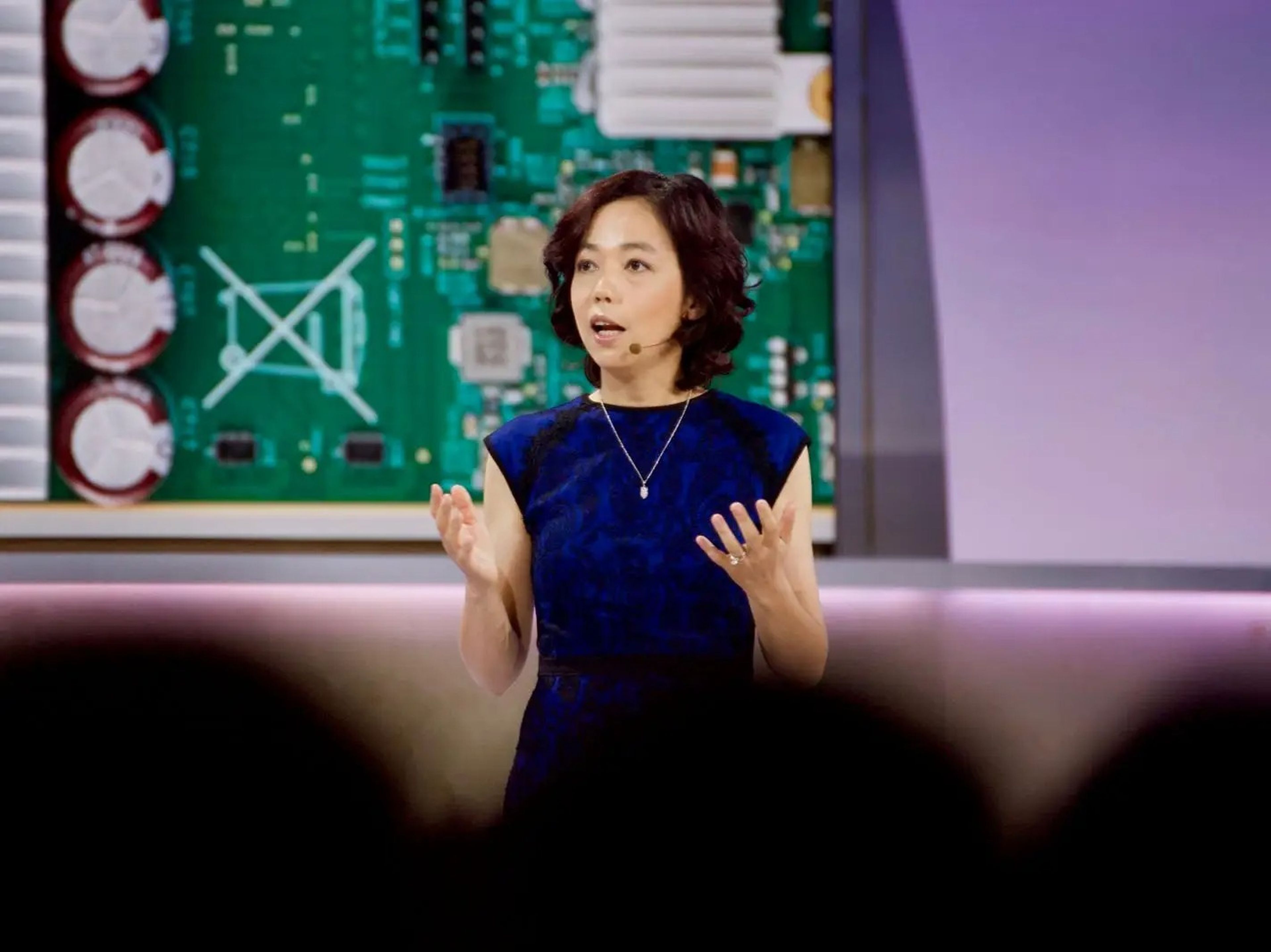

Fei-Fei Li es profesora de Informática en la Universidad de Stanford y fue vicepresidenta de Google

Greg Sandoval/Business Insider

La investigación de Li se centra en el aprendizaje automático, el aprendizaje profundo, la visión artificial y la IA de inspiración cognitiva, según su perfil en la página web de Stanford.

La profesora universitaria también es conocida por haber creado ImageNet, una gran base de datos visuales que fue diseñada para investigar el reconocimiento visual de objetos, así como el correspondiente desafío que plantea esta base de datos, en la que los programas de software compiten por clasificar correctamente los objetos.

A lo largo de los años, Li ha estado vinculada a gigantes tecnológicos como Google —donde fue vicepresidenta y directora científica de inteligencia artificial y aprendizaje automático— y Twitter (ahora X), donde formó parte del consejo de administración desde 2020 hasta la adquisición por parte de Elon Musk en 2022.

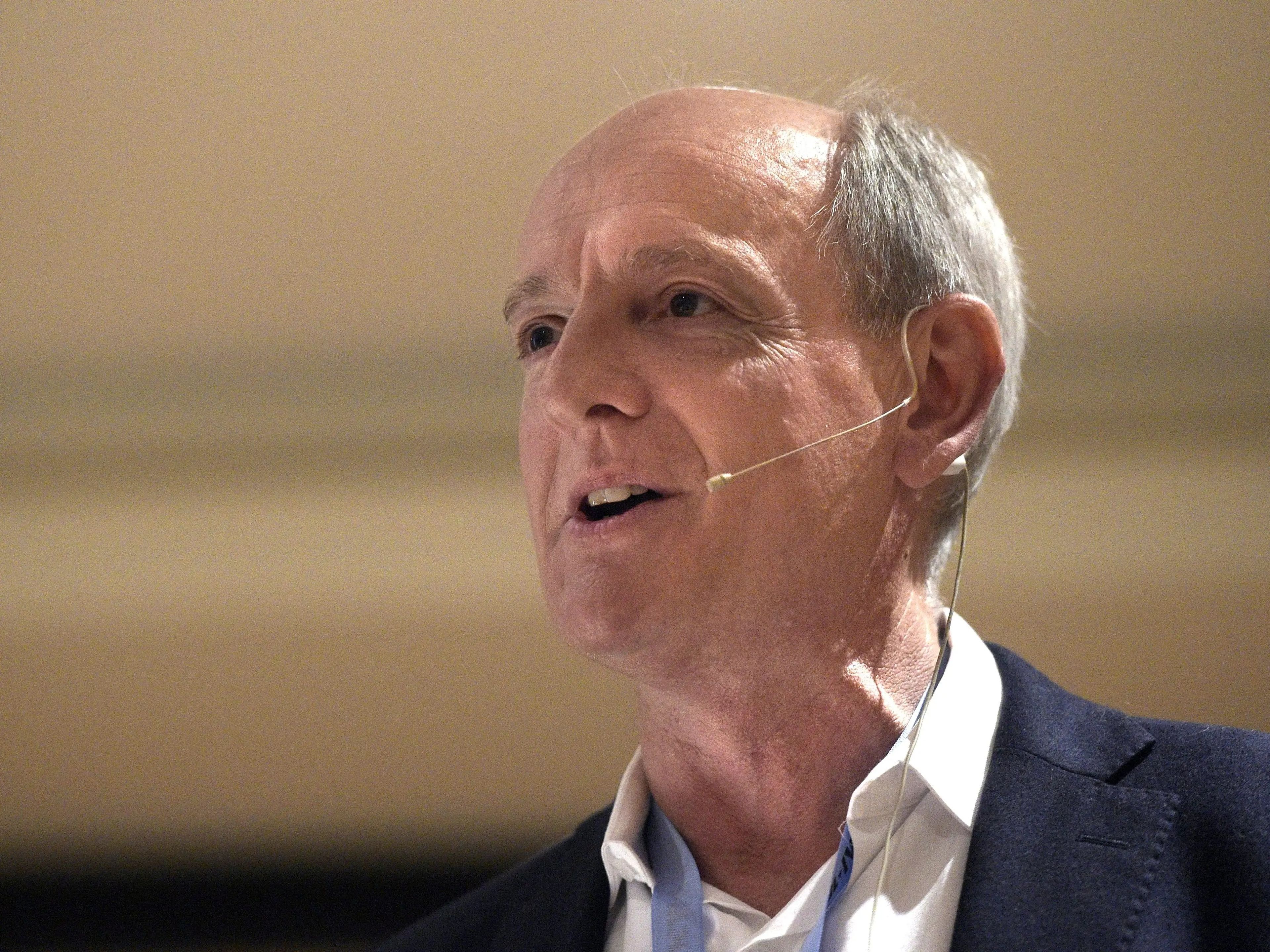

Stuart Russell, catedrático de la Universidad de Berkeley, lleva mucho tiempo preguntándose cómo será la relación entre la IA y la humanidad

Juan Mabromata/Staff/Getty

En 2019, Russell publicó Human Compatible, un libro en el que exploraba cómo los humanos y las máquinas podrían coexistir a medida que las máquinas se volviesen cada vez más inteligentes. Russell defendía que la respuesta estaba en diseñar bots que no tuviesen claras las prioridades humanas para que no priorizasen sus propios objetivos por encima de los de los humanos.

También es autor de textos fundamentales en este campo, como el libro Artificial Intelligence: A Modern Approach, que escribió junto con Peter Norvig, antiguo profesor de la UC-Berkeley.

En los últimos meses, Russell ha hablado abiertamente de lo que el rápido desarrollo de los modelos de IA puede suponer para la sociedad en su conjunto.

También ha advertido de que programas como ChatGPT se están "empezando a chocar con un muro de ladrillo" en cuanto a la cantidad de texto que les queda por ingerir. Russell afirmó que los avances de la IA podrían suponer el fin de las aulas tradicionales.

Peter Norvig desempeñó un papel fundamental en la dirección de la investigación sobre inteligencia artificial en Google

Cortesía de Peter Norvig

A principios de la década de los 2000, Norvig pasó varios años dirigiendo el grupo central de algoritmos de búsqueda de Google y más tarde pasó a desempeñar el cargo de director de investigación, donde supervisó equipos de traducción automática, reconocimiento de voz y visión artificial.

También ha pasado por varias instituciones académicas a lo largo de los años como exmiembro de la facultad de UC-Berkeley, antiguo profesor de la Universidad del Sur de California y, ahora, investigador en el centro de Valores humanistas en la Inteligencia Artificial —del inglés Human-Centered AI, HAI— de Stanford.

Norvig ha declarado a Business Insider por correo electrónico que "la investigación en IA se encuentra en un momento muy emocionante, en el que estamos empezando a ver modelos que pueden rendir bien (aunque no perfectamente) en una amplia variedad de tareas generales".

Sin embargo, ha añadido que, "al igual que ocurre con internet, existe el riesgo de que estos potentes modelos de inteligencia artificial puedan ser utilizados maliciosamente por personas sin escrúpulos para difundir desinformación [...]. Un tema importante de la investigación actual es la defensa contra ese tipo de ataques".

Timnit Gebru es una informática conocida por su trabajo sobre los sesgos en los algoritmos de IA

Kimberly White/Getty

Gebru fue investigadora científica y codirectora técnica del equipo de Inteligencia Artificial Ética de Google, donde publicó investigaciones pioneras sobre los sesgos en el aprendizaje automático. Su investigación, sin embargo, también derivó en una controversia mayor que, según ella, finalmente la llevó a ser despedida de Google en 2020. En ese momento, Google no hizo declaraciones al respecto.

Gebru fundó el Distributed AI Research Institute en 2021, una institución académica que se presenta como un "espacio para la investigación independiente y comunitaria de la IA, libre de la influencia omnipresente de las Big Tech".

Hace un tiempo advertía de que la fiebre del oro de la inteligencia artificial iba a hacer que las compañías descuidasen la implementación de las medidas de seguridad necesarias en torno a esta tecnología.

"A menos que exista presión externa para hacer algo diferente, las empresas no van a autorregularse", declaró la científica computacional. "Necesitamos regulación y necesitamos algo mejor que el simple afán de lucro".

El informático británico-estadounidense Andrew Ng fundó un proyecto de deep learning masivo llamado "Google Brain" en 2011

Steve Jennings/Stringer/Getty

El esfuerzo de varios investigadores condujo al Google Cat Project, un logro en la investigación del aprendizaje profundo en el que se entrenó una red neuronal masiva para detectar vídeos de gatos en YouTube.

Ng también fue científico jefe en el gigante tecnológico chino Baidu, donde dirigió la estrategia de inteligencia artificial. A lo largo de su carrera, ha escrito más de 200 artículos de investigación sobre temas que van desde el aprendizaje automático a la robótica, según su página web.

Más allá de su propia investigación, Ng ha sido pionero en la educación online. Cofundó Coursera junto con la informática Daphne Koller en 2012 y, cinco años después, fundó la empresa de tecnología educativa DeepLearning.AI, que ha desarrollado programas de IA en Coursera.

"Creo que la inteligencia artificial sí que tiene riesgos. Existe el sesgo, la imparcialidad, la concentración de poder, la amplificación de discursos de odio, la generación de discursos tóxicos, el desplazamiento de puestos de trabajo. Existen riesgos reales", reconoció a Bloomberg hace unos meses.

Sin embargo, añadió que no cree que la IA vaya a suponer un riesgo existencial para la humanidad. En todo caso, es probable que sea parte de la solución: "Si queremos que la humanidad sobreviva y prospere durante los próximos mil años, en lugar de ralentizarla, preferiría que la inteligencia artificial fuese más rápida para ayudarnos a resolver estos problemas".

Daphne Koller es la fundadora y CEO de Insitro, una startup de descubrimiento de fármacos que utiliza el aprendizaje automático

Cortesía de Insitro

Koller ha explicado a Business Insider por correo electrónico que Insitro aplica la inteligencia artificial y el aprendizaje automático para avanzar en la comprensión de "la biología de las enfermedades humanas e identificar intervenciones terapéuticas significativas".

Antes de fundar Insitro, Koller fue directora de informática en Calico, la spinoff de prolongación de la vida de Google. Koller es una profesora condecorada, investigadora de MacArthur y autora de más de 300 publicaciones con un índice h de más de 145, según su biografía del Instituto Broad.

Según esta especialista en IA, los mayores riesgos que el desarrollo de esta tecnología son "la esperada reducción de la demanda de ciertas categorías laborales; el mayor debilitamiento de 'la verdad' (debido al creciente desafío que supone poder distinguir lo que es real de lo que no); y la forma en que la inteligencia artificial permite a la gente hacer cosas malas".

Al mismo tiempo, Koller sostiene que los beneficios son demasiados y demasiado grandes para hacerse una idea: "La IA acelerará la ciencia, personalizará la educación, ayudará a identificar nuevas intervenciones terapéuticas y muchas cosas más".

Daniela Amodei cofundó la startup de inteligencia artificial Anthropic en 2021, tras su salida de OpenAI

Cortesía de Anthropic

Amodei cofundó Anthropic junto con otros seis empleados de OpenAI, incluido su hermano, Dario Amodei. Al parecer, se marcharon, en parte, porque a Dario —el principal investigador de seguridad de OpenAI en aquel momento— le preocupaba que el acuerdo de la desarrolladora de ChatGPT con Microsoft le obligase a lanzar productos demasiado rápido y sin las precauciones necesarias.

En Anthropic, Amodei se centra en garantizar la confianza y la seguridad de la IA. El chatbot Claude de la empresa se presenta como una alternativa más fácil de usar que ChatGPT y ya está siendo implementado por empresas como Quora y Notion.

La startup de los hermanos Amodei se basa en lo que se denomina un marco de "Triple H", siglas en inglés de "útil, honesto e inofensivo". Eso significa que Anthropic se basa en la aportación humana a la hora de entrenar sus modelos, incluida la inteligencia artificial fundacional, en la que un cliente esboza los principios básicos sobre cómo debería funcionar la IA.

"Todos tenemos que analizar simultáneamente los problemas actuales y pensar realmente en cómo avanzar en ellos, sin perder de vista el futuro de los problemas que se avecinan", declaró Amodei hace unos meses a Business Insider.

Demis Hassabis ha señalado que la inteligencia artificial general llegará en unos años

Samuel de Roman/Getty

Hassabis, un niño prodigio del ajedrez que estudió en Cambridge y en el University College de Londres, fue apodado el "superhéroe de la inteligencia artificial" por The Guardian en el 2016.

Tras varios periodos de investigación y una aventura en el mundo de los videojuegos, Hassabis fundó DeepMind en 2010. Cuatro años más tarde, en 2014, la vendió a Google por 400 millones de libras (unos 468 millones de euros al tipo de cambio actual).

Este superhéroe ha trabajado en algoritmos para abordar problemas de salud y de cambio climático, y también lanzó una unidad de investigación dedicada a la comprensión del impacto ético y social de la IA en 2017, según la página web de la propia DeepMind.

Hassabis afirmó hace unos meses que la promesa de la inteligencia artificial general —IAG, un concepto teórico que considera que la inteligencia artificial puede llegar a igualar las capacidades cognitivas de los seres humanos— está a la vuelta de la esquina.

"Creo que tendremos sistemas muy capaces y muy generales en los próximos años", señaló el fundador de DeepMind, que añadió que no veía por qué el progreso de la inteligencia artificial podía ralentizarse. Aun así, Hassabis reconoció que el desarrollo de la IAG debe desarrollarse "con cautela y utilizando el método científico".

En 2022, Mustafa Suleyman, cofundador de DeepMind, lanzó la empresa de inteligencia artificial Inflection AI junto a Reid Hoffman, cofundador de LinkedIn, y a Karén Simonyan, actual directora científica de la empresa

Cortesía de Inflection AI

La startup, que pretende crear "una IA personal para todos", recaudó hace unos meses cerca de 1.180 millones de euros de financiación, según PitchBook.

Su chatbot, Pi, cuyo nombre se corresponde con las siglas de "inteligencia personal", se entrena con grandes modelos lingüísticos similares a ChatGPT o Bard, de Google. Pi, en cambio, está diseñado para ser más conversacional y ofrecer apoyo emocional. Suleyman lo ha llegado a describir como un "oyente neutral", que puede responder a problemas de la vida real.

"Muchas personas solo quieren que se les escuche y quieren una herramienta que reproduzca lo que han dicho para demostrar que realmente se les ha escuchado", indicaba Suleyman ante los medios de comunicación.

La profesora de la USC Kate Crawford se centra en las implicaciones sociales y políticas de los sistemas de inteligencia artificial a gran escala

Cortesía de Kate Crawford

Crawford también es investigadora principal en Microsoft y autora de Atlas of AI, un libro que se basa en la amplitud de sus investigaciones para desvelar cómo la IA está moldeando la sociedad.

La investigadora se muestra a la vez optimista y cauta con respecto al estado del desarrollo de la IA. A través de un correo electrónico, ha asegurado a este medio de comunicación que está entusiasmada con las personas con las que trabaja en todo el mundo, "que están comprometidas con enfoques más sostenibles, basados en el consentimiento y equitativos para utilizar la IA generativa".

Sin embargo, ha añadido que "si no abordamos el desarrollo de la inteligencia artificial con cuidado y precaución, y sin las salvaguardas regulatorias necesarias, podría darse concentraciones extremas de poder, con efectos peligrosamente antidemocráticos".

Margaret Mitchell es la responsable de Ética de Hugging Face

Cortesía de Margaret Mitchell

Mitchell ha publicado más de 100 artículos académicos a lo largo de su carrera, según su página web, y ha encabezado proyectos de inteligencia artificial en varias grandes empresas tecnológicas, como Microsoft y Google.

A finales de 2020, Mitchell publicó un artículo sobre los riesgos de los grandes modelos lingüísticos, junto con Timnit Gebru, que entonces codirigía el equipo de Inteligencia Artificial Ética de Google.

El documento provocó desacuerdos entre las investigadoras y la dirección de Google, lo que finalmente llevó a la salida de Gebru de la empresa en diciembre de 2020. Mitchell fue despedida por Google apenas dos meses después, en febrero de 2021.

Ahora, en Hugging Face, una plataforma de ciencia de datos y aprendizaje automático de código abierto fundada en 2016, Mitchell está pensando en cómo democratizar el acceso a las herramientas necesarias para construir y desplegar modelos de IA a gran escala.

En una entrevista con Morning Brew, donde la investigadora explicó lo que significa diseñar una IA responsable, comentó: "Empecé mi camino hacia el trabajo en lo que ahora se llama inteligencia artificial en el 2004, específicamente con un interés en alinear la IA más cerca del comportamiento humano".

"Con el tiempo, esto ha ido evolucionando y ahora se trata menos de imitar a los humanos y más de tener en cuenta el comportamiento humano y trabajar con los humanos de forma asistencial y aumentativa", agregó.

Navrina Singh es la fundadora de Credo AI, una plataforma de gobernanza de la inteligencia artificial

Cortesía de Navrina Singh

Credo AI es una plataforma que ayuda a las empresas a asegurarse de que cumplen con la creciente normativa sobre el uso de la IA.

En declaraciones a Business Insider, Singh ha sugerido que, al automatizar los sistemas que conforman la vida, la inteligencia artificial tiene la capacidad de "liberarnos para desarrollar nuestro potencial en todos los ámbitos en los que se implante".

Al mismo tiempo, sostiene que los algoritmos ahora mismo carecen del juicio humano necesario para adaptarse a un mundo cambiante.

"A medida que integramos la IA en la infraestructura fundamental de la civilización, estos equilibrios adquieren implicaciones existenciales", ha opinado Singh. "Conforme avanzamos, la responsabilidad de armonizar los valores humanos y el ingenio con la precisión algorítmica no es negociable. La gobernanza responsable de la inteligencia artificial es primordial".

Richard Socher, antiguo ejecutivo de Salesforce, es el fundador y director ejecutivo de You.com, un motor de búsqueda impulsado por IA

Cortesía de You.com

Socher cree que todavía queda camino por recorrer antes de que el desarrollo de la IA alcance su punto álgido o se acerque a la inteligencia humana.

Uno de los cuellos de botella de los grandes modelos lingüísticos tiene que ver con su tendencia a alucinar, un fenómeno por el que ofrece de forma convincente errores de facto como si fuesen verídicos.

Pero, si les obligas a traducir las peticiones a código fuente —es decir, a "programar" las respuestas— en lugar de a verbalizarlas, puedes "darles mucho más combustible para los próximos años en cuanto a lo que pueden hacer", apunta Socher.

Aun así, ese es solo un objetivo a corto plazo. Este directivo sostiene que la humanidad se encuentra a años luz de la ambiciosa apuesta de la industria por la inteligencia artificial general.

Socher define esta tecnología como "una forma de inteligencia que puede aprender como los humanos" y "tener la misma inteligencia motora y visual, lingüística y lógica que algunas de las personas más lógicas", y que podría tardar apenas diez años en llegar o dilatarse hasta dentro de dos siglos.

Si realmente se desea marcar la diferencia y apostar por la IAG, este empresario asegura que los seres humanos podrían tener que soltar las riendas y dejar atrás sus propias intenciones para obtener beneficios, desarrollando así una inteligencia artificial que pueda establecer sus propios objetivos.

"Una parte importante de la inteligencia es no limitarse a hacer robótica y mecánicamente lo mismo una y otra vez. Creo que no diríamos que una entidad es muy inteligente si todo lo que puede hacer es exactamente lo que está programada para hacer", ha explicado Socher a Business Insider.

Conoce cómo trabajamos en BusinessInsider.

Etiquetas: TrendingInteligencia artificial, Microsoft, ChatGPT, Google, OpenAI