El Gran Hermano de la vigilancia: la IA puede detectar tus emociones y hacer que te despidan

Anna Kim para Business Insider

- La inteligencia artificial emocional (IAE) es una tecnología que, supuestamente, puede detectar tus emociones a través de sus expresiones faciales, tono de voz o incluso mensajes de texto.

- Algunas empresas ya la utilizan para contratar y despedir gente o aumentar la productividad, pero esto implica que las empresas se meten cada vez más en la intimidad de sus trabajadores.

¿Puede una máquina saber si estás enfadado con solo mirarte a la cara? ¿Puede conocer tu nivel de estrés por tus correos electrónicos? ¿Podría un ordenador entender tus emociones mejor que tú mismo?

Según una oleada de nuevas startups, la respuesta a todo lo anterior es un rotundo sí. Un grupo de empresas está tratando de vender la idea de que la inteligencia artificial de las emociones (IAE, por sus siglas en inglés) puede captar sutiles movimientos faciales de los que ni siquiera somos conscientes, utilizarlos para determinar lo que sentimos y convertir esos sentimientos privados en datos cuantificables. Según sus creadores, la IAE puede distinguir la felicidad, la confusión, la ira e incluso el afecto. En teoría, esta tecnología hace posible que un ordenador conozca nuestras emociones, aunque nosotros mismos no las conozcamos.

Para las empresas, la inteligencia artificial puede ser una mina de oro. Ser capaz de entender los pensamientos, sentimientos y personalidades auténticas de los clientes facilitaría mucho a las empresas la venta de sus productos. Imagina que estás navegando por una app de compras y no te gusta lo que ves. Con la inteligencia artificial emocional, la aplicación se daría cuenta y te ofrecería rápidamente el contenido que, en su opinión, podría animarte a comprar. Algunas compañías ya están utilizando esta tecnología para fabricar juguetes inteligentes, robots, vehículos y chatbots de IA con capacidad empática. Y más allá de esto, la IAE podría ser útil en el entorno laboral: conocer el estado de ánimo de un candidato o empleado puede ayudar a tomar decisiones que mejoren la productividad y mantengan el ritmo de trabajo.

Pero hay un problema: no está claro que la IAE funcione. Los expertos en la materia no están de acuerdo con los fundamentos científicos de esta tecnología, y algunos críticos afirman que no es posible entender cómo nos sentimos examinando nuestras expresiones faciales. Sin embargo, esto no impide que se esté usando la inteligencia artificial emocional para espiar a empleados, descubrir cómo se sienten e identificar a quién deben contratar y a quién despedir. La IA está a punto de influir en todos los aspectos de la vida laboral, pero éste puede ser uno de los más peligrosos. Sin que nos demos cuenta, nuestros jefes podrían estar adivinando nuestras emociones privadas y utilizándolas en nuestra contra.

Cómo funciona

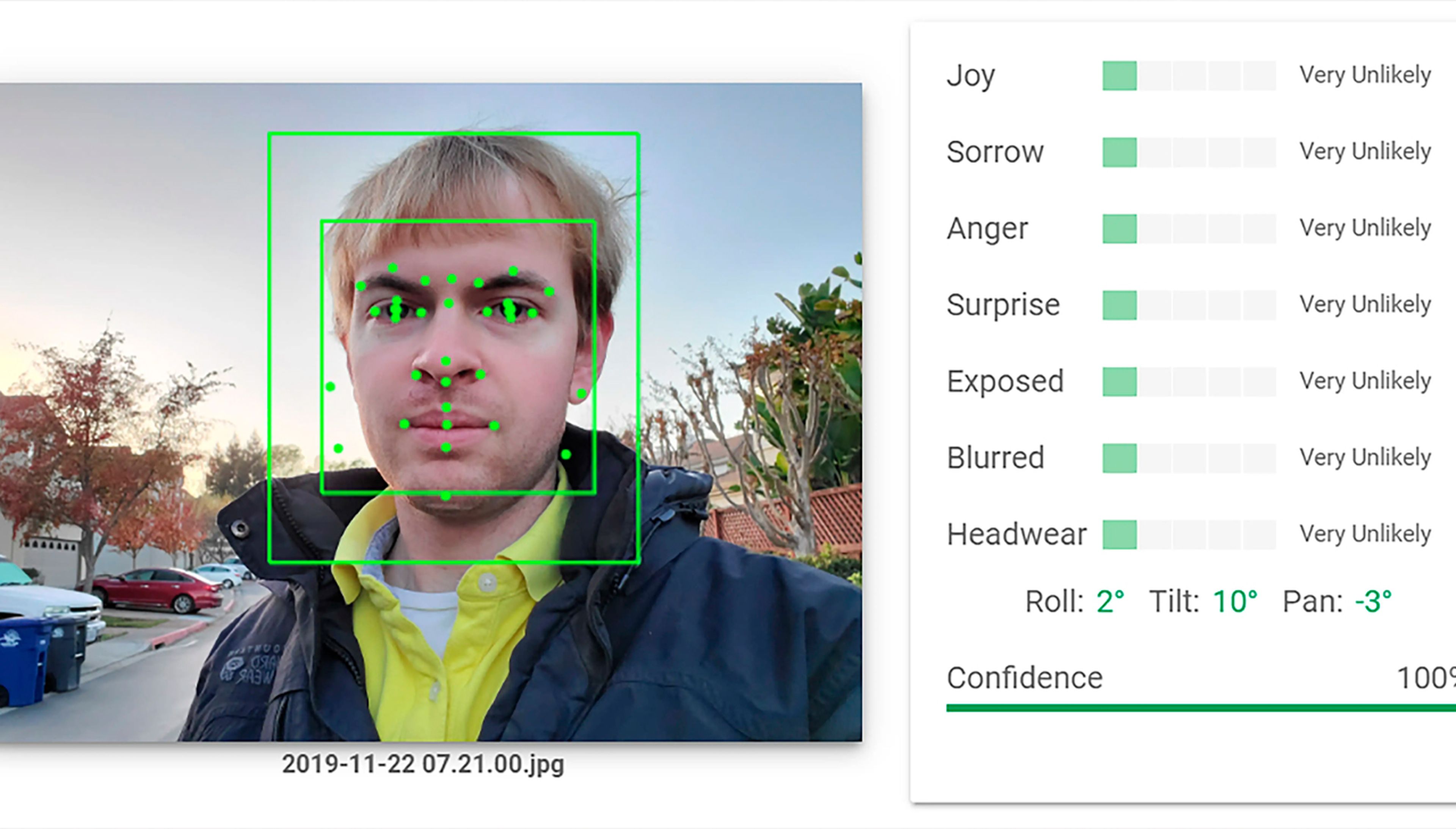

Aunque la IA emocional lleva en desarrollo desde finales de los años 90, el sector ha despegado en los últimos años gracias a que la tecnología de base de la IA se ha vuelto más sofisticada y al aumento del interés en este campo. Hoy en día, la cantidad de datos con los que se puede entrenar la inteligencia artificial emocional es abrumadora. Las compañías la utilizan para medir, por ejemplo, la respiración, la frecuencia cardiaca, la transpiración, los cambios en la piel y la postura corporal.

La información tiene muchas aplicaciones, como detectar si alguien miente en las reclamaciones de seguros, ayudar a diagnosticar la depresión o hacer un seguimiento de la respuesta de los alumnos a un profesor durante el aprendizaje online. Algunas versiones de la IAE se centran en las señales verbales y rastrean pequeñas pausas en la conversación y cambios de tono. Otras tienen en cuenta la dilatación de las pupilas y la mirada. También hay modelos que leen tus correos electrónicos otros mensajes y generan informes detallados sobre las emociones que puedes estar expresando inconscientemente.

Gabi Zijderveld, directora de marketing de Smart Eye, una empresa de inteligencia artificial emocional que afirma que su tecnología "entiende, apoya y predice el comportamiento humano", indica que la empresa había acumulado grandes cantidades de datos basados en las emociones mediante el análisis de más de 14,5 millones de vídeos de expresiones faciales realizados con voluntarios. Describe su inteligencia artificial como "básicamente un análisis del ser humano, de sus expresiones faciales y sus movimientos para entender su estado emocional y, tal vez, cognitivo".

Smith Collection/Gado

Smart Eye utiliza esta tecnología para cosas como detectar la fatiga de un conductor mediante una mezcla de análisis facial y seguimiento ocular. También proporciona análisis a empresas de publicidad y entretenimiento. En estos casos, los participantes ven vídeos online y la tecnología IAE analiza sus expresiones faciales para determinar si un chiste ha tenido gracia o si un momento concreto ha provocado la respuesta emocional esperada. (Zijderveld recalca que la participación en estas pruebas siempre ha sido opcional). A continuación, la empresa utiliza esos datos (combinados con la información demográfica que proporcionan los participantes) para, según Zijderveld, "empezar a segmentar cómo reaccionan las distintas poblaciones ante ese contenido".

Empresas como CBS y Disney pueden utilizar esta información para adaptar sus productos en función de la reacción de la gente. Modificar un tráiler, eliminar un chiste o cambiar un anuncio en función de la demografía del público al que se dirigen, por ejemplo.

Control de las emociones de los empleados

Aunque estas aplicaciones pueden parecer inofensivas o incluso beneficiosas, el uso de la inteligencia artificial emocional en el mundo laboral es mucho más problemático. Los trabajadores no se dan cuenta muchas veces de que se está utilizando, lo que significa que podría detectarse infelicidad, inestabilidad emocional o demasiado estrés sin ni siquiera saber que están siendo vigilados.

HireVue, una plataforma de selección de personal de Utah, empezó a utilizar el análisis facial con IAIE en 2014 como parte de su proceso de entrevistas a candidatos. La idea era noble: se suponía que inteligencia artificial emocional mitigaría los prejuicios y detectaría a los candidatos ideales mediante la identificación de las habilidades blandas, la capacidad cognitiva, los rasgos psicológicos y la inteligencia emocional durante las entrevistas en vídeo. Cientos de empresas, incluidas Ikea, Dow Jones y Oracle, utilizaron el software para evaluar a más de 1 millón de solicitantes de empleo, según The Washington Post.

Pero en 2019, una queja del Centro de Información de Privacidad Electrónica de Estados Unidos alegó "prácticas desleales y engañosas" porque no se demostró que la tecnología de HireVue pudiera hacer lo que la compañía decía. La queja apuntaba a investigaciones que descubrieron que el análisis facial podría ser sesgado contra las mujeres, las personas de color y las personas con diferencias neurológicas, y argumentó que no debería usarse para tomar decisiones de contratación.

A menudo, los empleados desconocen que su empresa utiliza esta tecnología mientras trabajan

En respuesta a la protesta pública, la empresa declaró en 2021 que dejaría de utilizar el análisis facial con IAE porque no merecía la pena, pero que seguiría analizando el habla, la entonación y el comportamiento durante las entrevistas. Según la compañía, los elementos verbales eran suficientes para sacar conclusiones sobre el estado emocional de un candidato. "Los algoritmos no observan un poder predictivo adicional significativo cuando los datos no verbales se añaden a los datos lingüísticos", afirmó.

Otras plataformas de contratación, como Retorio, una "plataforma de inteligencia conductual" de Múnich, utilizan una combinación de análisis facial, reconocimiento de la postura corporal y análisis de la voz "para crear un perfil de rasgos de personalidad y aptitudes interpersonales de los candidatos, lo que permite a los responsables de contratación tomar decisiones más inteligentes sobre la contratación de vendedores", según la web de la empresa. También afirma que su tecnología elimina los prejuicios y que el proceso es voluntario para los candidatos, que pueden renunciar en cualquier momento antes de que la grabación de vídeo se envíe a la empresa contratante y presentar su candidatura de otra manera.

Sarah Myers West, directora del AI Now Institute, se muestra escéptica ante las afirmaciones de la empresa de que la inteligencia artificial emocional está libre de prejuicios. "No hay ningún escenario en el que se pueda hacer ese tipo de afirmación con rigor", afirma. Y aunque Retorio haga hincapié en el carácter voluntario de su tecnología, las empresas que la utilizan podrían estar descartando a aquellos que deciden no someterse a una entrevista de vídeo.

Una vez contratados, los trabajadores no están libres del análisis. En los centros de atención telefónica, la inteligencia artificial emocional ya se utiliza para captar las emociones de los agentes de atención al cliente y de los clientes. Puede dar información en tiempo real sobre cómo ajustar su tono a lo que los algoritmos consideran apropiado. Esto ha hecho que algunos se sientan confusos ante los comentarios negativos y temerosos de que la tecnología les meta en problemas si no sonaban lo suficientemente positivos, según descubrieron varios investigadores.

Y otras empresas se están apresurando a desarrollar artilugios con inteligencia artificial emocional para profundizar aún más en la mente de los empleados. Framery, una firma que fabrica sillas de oficina de alta gama utilizadas por empresas como LinkedIn y Nvidia, ha empezado a probar recientemente una silla de oficina con biosensores. "Podemos medir la frecuencia cardíaca y su variabilidad, la frecuencia respiratoria y el nerviosismo de las personas", explica Samu Hällfors, fundador de la compañía con sede en Helsinki, Finlandia.

Framery también ha patentado una herramienta para medir la risa basándose solo en el movimiento del cuerpo. Hällfors prevé que las empresas incluyan pronto en sus informes métricas del bienestar de los empleados. Si eso ocurre, Framery podrá intervenir y recopilar anónimamente los datos de sus sillas inteligentes para ayudar a las empresas a determinar cómo se sienten los empleados en sus puestos y cuál es su nivel de estrés.

Pero West ha puesto en duda las pretensiones de mantener anónimos los datos emocionales: "Estás tratando con datos identificables de forma inherente si trabajas con biometría y reconocimiento de emociones". Y añade: "Hay tantos flujos de datos que se recogen que la pretensión de anonimato se viene abajo".

A los fundadores de Looksery, una empresa de fotografía y software propiedad de Snap Inc, se les concedió una patente en 2017 para una tecnología de videoconferencia denominada "Emotion Recognition For WorkForce." Aunque no está claro si se está utilizando, la patente cubre el reconocimiento de emociones para videollamadas, especialmente para los centros de atención al cliente, y dice sin ambigüedades que "un empleador puede utilizar esta información para la optimización de la fuerza de trabajo, el despido de empleados de bajo rendimiento, la promoción de aquellos empleados que tienen actitudes positivas hacia los clientes o la toma de otras decisiones administrativas".

Kat Roemmich, estudiante de doctorado de la Escuela de Información de la Universidad de Michigan que ha realizado investigaciones sobre inteligencia artificial emocional, ha descubierto que los trabajadores suelen ignorar que su empresa utiliza esta tecnología mientras están en el trabajo. De hecho, los empresarios no están obligados a decírselo en algunos países. La información emocional puede obtenerse "analizando los datos que ya se recogen en el marco de los programas de control y vigilancia existentes", afirma Roemmich, lo que significa que las empresas pueden incorporar la IAE a los programas de vigilancia sin alertar a los empleados.

La rápida expansión de los programas de vigilancia durante la pandemia debido al trabajo a distancia ha dejado a más gente expuesta al espionaje de sus emociones. Dado que la inteligencia artificial emocional no se considera un dato biométrico identificable de forma única, como ocurre con las huellas dactilares o el escáner facial, no está regulada en Estados Unidos. En Europa, la UE está trabajando en un proyecto de ley que probablemente lo ilegalizaría en el lugar de trabajo. Pero hasta que haya una regulación, las empresas son libres de llevar estas prácticas a cabo.

¿Pseudociencia?

Además de los problemas éticos de la inteligencia artificial emocional, la tecnología se enfrenta a otro reto: puede que ni siquiera funcione. La IAE que interpreta las expresiones faciales suele basarse en las investigaciones del psicólogo estadounidense Paul Ekman, que propuso que las emociones humanas básicas (miedo, ira, alegría, tristeza, asco y sorpresa) se revelaban a través de expresiones faciales universales que trascendían las diferencias culturales. Pero el trabajo de Ekman se ha enfrentado a mucho rechazo en los últimos años, y no hay consenso entre los científicos sobre la definición de las emociones humanas específicas, o cómo podrían detectarse con precisión en la cara de alguien.

Un estudio de 2019 sobre el reconocimiento de emociones mediante el análisis facial concluyó que no había pruebas suficientes de la existencia de un vínculo entre las expresiones faciales y las emociones. Los autores del documento dijeron: "Se sabe muy poco sobre cómo y por qué ciertos movimientos faciales expresan instancias de emoción, particularmente a un nivel de detalle suficiente para que tales conclusiones se utilicen en aplicaciones importantes del mundo real." También señalaron que los distintos contextos y culturas pueden dar lugar a una enorme variedad de expresiones para una misma emoción.

No hay consenso entre los científicos sobre la definición de las emociones humanas específicas ni sobre cómo leerlas con precisión en la cara de alguien.

Las empresas del sector de la inteligencia artificial emocional no están de acuerdo. Zijderveld, de Smart Eye, dice que la gran cantidad de datos de la empresa, procedentes de unos 90 países, "nos permite tener en cuenta estas sensibilidades culturales". Añade que conocer el contexto es claramente importante para entender la correlación entre emociones y expresiones faciales.

Pero la opacidad del sector hace casi imposible obtener pruebas independientes basadas en investigaciones sobre el funcionamiento de la tecnología. "Para mí es un punto de fricción", afirma Roemmich. "Si no conseguimos enmarcar bien los debates y las cuestiones fundamentales los profesionales que utilizan la emocionalidad van a hacer caso omiso de ella, como ya estamos viendo".

Incluso si la tecnología puede captar realmente los sentimientos internos, su uso en el entorno laboral da a las empresas un acceso sin precedentes a las emociones privadas de sus empleados. Y si no puede, entonces las empresas que utilizan inteligencia artificial para contratar o despedir podrían estar totalmente equivocadas.

En cualquier caso, es un indicio preocupante de cómo las empresas se están metiendo en cada parte de nuestras vidas, incluso en nuestros pensamientos y sentimientos más íntimos.

Otros artículos interesantes:

Conoce cómo trabajamos en Business Insider.