El padrino de la IA cree que esta tecnología podría tomar el control de la humanidad en el futuro

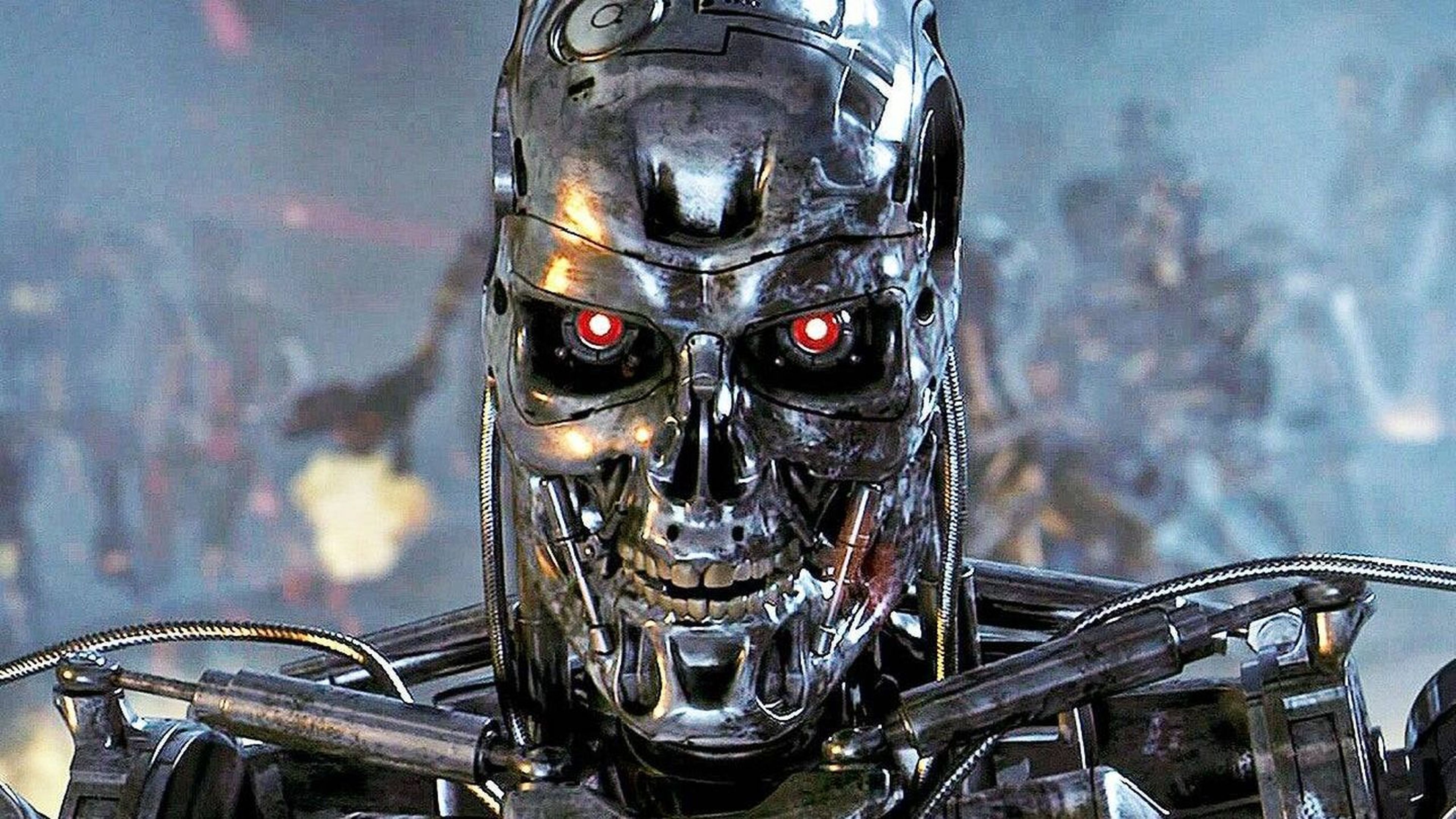

Warner Bros

- Geoffrey Hinton, el llamado padrino de la IA, tiene claro que esta tecnología podría tomar el control de la humanidad en el futuro.

- "Sí, es una posibilidad. No digo que vaya a ocurrir. Si pudiéramos impedir que lo hicieran, sería estupendo. Pero no está claro que podamos evitar que quieran hacerlo", explica en una entrevista en 60 Minutes.

Geoffrey Hinton, el llamado padrino de la IA, ha hablado sobre los puntos tanto positivos como negativos de la inteligencia artificial en el programa 60 Minutes del que se hace eco Yahoo.

Durante la entrevista, el informático y psicólogo cognitivo, que pasó una década trabajando con Google, tiene claro que estamos entrando en un periodo en el que, "por primera vez en la historia, tenemos cosas más inteligentes que nosotros".

Además, también habló sobre que en algún momento del futuro, la IA tendrá autoconciencia y, en consecuencia, "los seres humanos serán los segundos seres más inteligentes del planeta".

Es llamativo, puesto que al final la IA ha sido diseñada por personas, pero esto, según Hinton, no es del todo cierto.

"Lo que hicimos fue diseñar el algoritmo de aprendizaje. Es un poco como diseñar el principio de la evolución", explica.

"Pero cuando este algoritmo de aprendizaje interactúa después con los datos, produce complicadas redes neuronales que son buenas haciendo cosas. Pero no sabemos exactamente cómo lo hacen", agrega.

Hinton tiene claro también que la IA ofrece muchos beneficios, como los que ya se han visto en atención sanitaria, pero también ve puntos negativos.

"Tenemos una idea muy aproximada de lo que hace", dice Hinton sobre cómo los sistemas de IA se enseñan a sí mismos. "Pero en cuanto se complica, no sabemos lo que está pasando, igual que no sabemos lo que pasa en nuestro cerebro".

Esta opinión es sólo la punta del iceberg de las preocupaciones que rodean a la IA, y Hinton señala un gran riesgo potencial a medida que los sistemas se hacen más inteligentes.

"Una de las formas en que estos sistemas podrían escapar al control es escribiendo su propio código informático para modificarse a sí mismos. Y eso es algo que debe preocuparnos seriamente", afirma.

A medida que la IA tenga más información, seguirá mejorando en la manipulación de las personas. "Creo que dentro de cinco años será capaz de razonar mejor que nosotros", señala Hinton.

Y esto implica muchos riesgos, como noticias falsas, riesgos de robots autónomos o incluso falta de trabajo para los humanos. "Habrá toda una clase de personas desempleadas y poco valoradas, porque lo que solían hacer ahora lo hacen las máquinas", explica.

El problema, según Hinton, es que no ve un camino a seguir que garantice totalmente la seguridad.

"Estamos entrando en un periodo de gran incertidumbre en el que nos enfrentamos a cosas que nunca antes habíamos hecho. Y normalmente, la primera vez que te enfrentas a algo totalmente nuevo, te equivocas. Y no podemos permitirnos equivocarnos con estas cosas", advierte.

Lo más grave es que durante la entrevista, cuando le preguntaron si la IA podría tomar el control de la humanidad, Hinton lo deja claro: "Sí, es una posibilidad. No digo que vaya a ocurrir. Si pudiéramos impedir que lo hicieran, sería estupendo. Pero no está claro que podamos evitar que quieran hacerlo".

Este podría ser un punto de inflexión en el que la humanidad tendría que enfrentarse a la decisión de si seguir desarrollando estas cosas y cómo protegerse en caso de hacerlo, afirma Hinton.

"Creo que mi mensaje principal es que hay una enorme incertidumbre sobre lo que va a ocurrir", añade. "Estas cosas entienden, y porque entienden tenemos que pensar mucho sobre lo que sigue, y simplemente no lo sabemos".

Otros artículos interesantes:

Descubre más sobre Carlos Ferrer-Bonsoms Cruz, autor/a de este artículo.

Conoce cómo trabajamos en Business Insider.