La guerra entre Israel y Hamás evidencia cómo las redes sociales han renunciado a los hechos

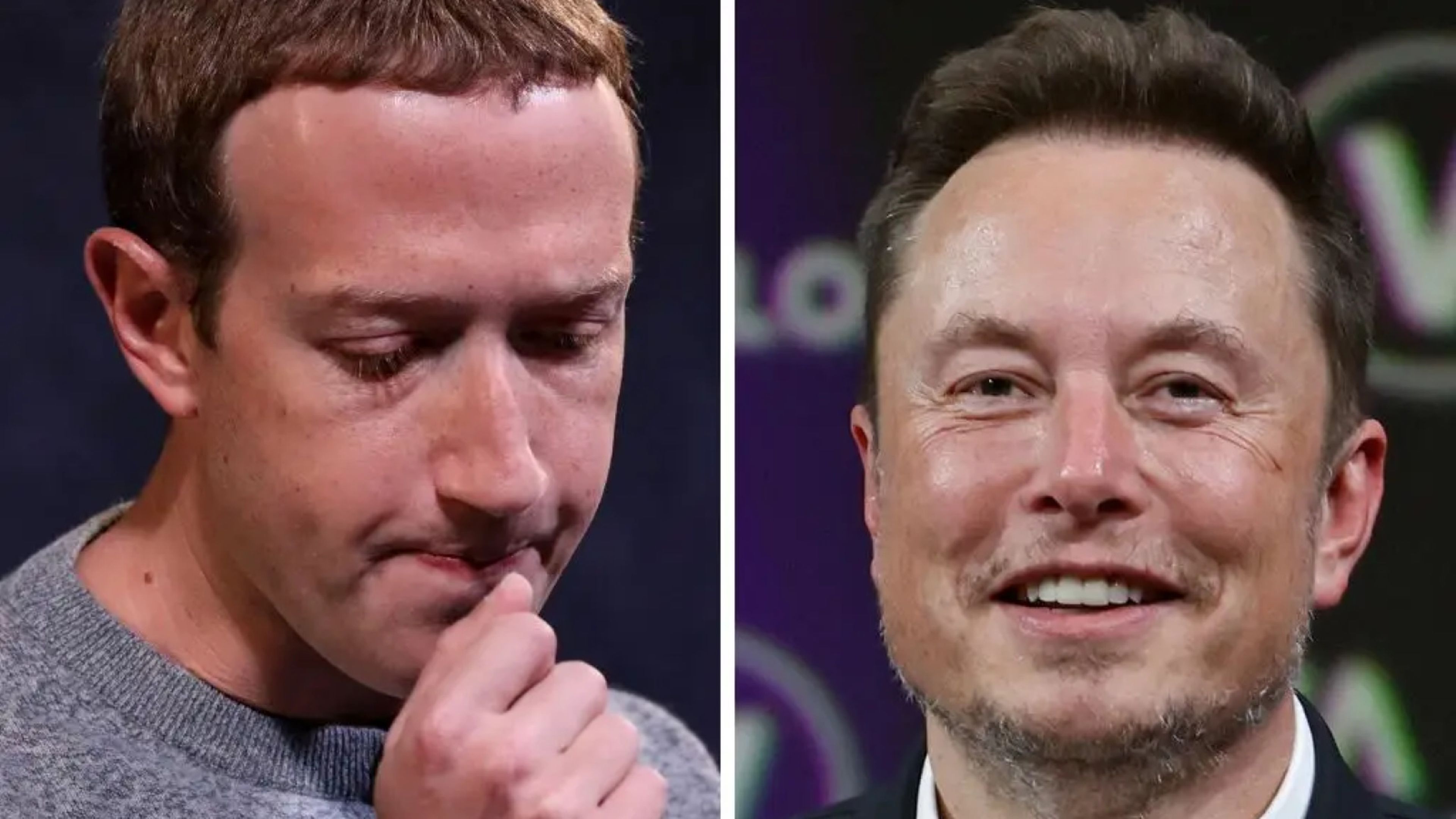

Drew Angerer via Getty Images; Chesnot via Getty Images

- La guerra entre Israel y Hamás revela cómo las plataformas de las redes sociales ya no quieren ocuparse de las noticias.

- Cuando se renuncia a las noticias, se renuncia a los hechos contrastados.

- Un experto en ciberseguridad afirma que los periodistas deberían dejar de corregir la información errónea en las redes sociales.

No hace mucho, las redes sociales eran el futuro de las noticias. Millones de personas podían conectarse a la plataforma de su elección durante los grandes acontecimientos y recibir un flujo de noticias de organizaciones dedicadas a comprobar la veracidad de la información.

Para acompañar este flujo de información verificada, Facebook, Twitter y otras empresas de redes sociales crearon grandes equipos de moderación de contenidos y establecieron diversas alianzas. Se trataba de un esfuerzo por limitar las noticias falsas y la desinformación difundida por terceros malintencionados, tergiversadores y otras personas que buscan engagement e influencia.

El cofundador de Twitter, Jack Dorsey, dijo en una entrevista en 2018 que Twitter había sido diseñado efectivamente para apoyar las noticias porque los usuarios "nos enseñaron para qué querían usarlo." Mark Zuckerberg, CEO y cofundador de Facebook, creó el News Feed en 2006, con una mezcla de actualizaciones sociales y enlaces a noticias como base de la plataforma. Más tarde, la empresa diseñó una pestaña dedicada a las Noticias.

Hoy, Twitter y Facebook, junto con otras plataformas de Meta, incluido el nuevo Threads, quieren tener muy poco que ver con contenidos informativos. Después de más de una década tratando de lidiar con los hechos, parecen haber decidido que los temas candentes, los famosos, la moda y otros temas más suaves ofrecen más engagement con menos riesgo. Facebook evita ahora promocionar noticias. El Twitter de Elon Musk, conocido como X, ha dejado de mostrar titulares de enlaces y favorece la desinformación, a condición de que se haga viral.

"La política y las noticias duras son importantes, no quiero insinuar lo contrario", escribió en julio el jefe de Instagram, Adam Mosseri. "Pero mi opinión es que, desde la perspectiva de la plataforma, el aumento del engagement o de los ingresos que puedan generar no merece en absoluto el control, la negatividad (seamos sinceros) o los riesgos para la integridad que conllevan".

Comprobar los hechos es difícil

Cuando las empresas de redes sociales renuncian a las noticias, lo que están haciendo en realidad es renunciar a un esfuerzo mayor por garantizar que la información que se comparte en sus plataformas es veraz.

Comprobar si algo es cierto es difícil y requiere mucho trabajo. Karan Singhal ayudó a crear MedPaLM 2 de Google, uno de los modelos de IA médica más potentes. Antes había intentado utilizar tecnología basada en IA para detectar información errónea. Singhal lo describe ahora como un "proyecto ingenuo".

Si uno de los mejores tecnólogos de IA no puede crear una tecnología capaz de abordar la verificación de los hechos online, quizá sea sensato que X, Facebook, TikTok y otras empresas tecnológicas renuncien también a estos esfuerzos. En el año de la eficiencia, no tiene sentido gastar dinero contratando más moderadores humanos cuando hay chatbots de IA que construir.

Meta, que controla Facebook, Instagram y WhatsApp, ha recortado cientos de puestos de trabajo que se centraban en la moderación de contenidos y áreas relacionadas, según la cadena CNBC. La compañía dice que todavía tiene miles de empleados y subcontratados que trabajan en la "seguridad y protección" de sus plataformas.

Mientras tanto, Twitter ha reducido a unos 20 trabajadores la plantilla dedicada a la moderación y la seguridad a tiempo completo, un equipo que estaba formado por cientos de trabajadores antes de la adquisición de Musk hace un año.

El apocalipsis informativo Israel-Hamás

La guerra entre Israel y Hamás es el primer acontecimiento importante en el que se pone de manifiesto el nuevo enfoque de las redes sociales, basado en hechos, y se ha producido una oleada de información falsa en las plataformas.

Shayan Sardarizadeh, periodista de BBC Verify, ha rastreado en X algunos de los peores ejemplos. Al leerlos, es fácil ver cómo las redes sociales pueden dividir a la gente en tiempos difíciles.

- Un post reciente mostraba a la estrella del fútbol Cristiano Ronaldo sosteniendo la bandera palestina. En realidad, se trataba de un futbolista marroquí de un vídeo de 2022. La cuenta de la red social se hizo pasar por un periodista de la BBC para compartir esta información errónea con fines de aumentar su engagement.

- Otra publicación supuestamente mostraba un vídeo de cohetes lanzados por Hamás contra Israel. En realidad era de la guerra de Siria y se compartió originalmente en Internet en 2020.

- Un vídeo gráfico, visto casi 500.000 veces, afirmaba mostrar un convoy militar de militantes de Hamás siendo blanco de un misil israelí. El fragmento se publicó realmente en Internet en 2019 y se filmó en Siria.

- Otro post ampliamente compartido afirmaba mostrar imágenes de Hamás o Israel fingiendo el asesinato de un niño por el otro bando. El vídeo era en realidad imágenes de una película publicada en TikTok en 2022.

Dejar de intentarlo

La situación ha empeorado tanto que Marcus Hutchins, un famoso hacker de ciberseguridad, aconseja ahora a las organizaciones de noticias y a periodistas como Sardarizadeh que simplemente se mantengan alejados de las redes sociales y no intenten corregir la información errónea publicada en ellas.

"Los periodistas pueden pensar que están contrarrestando la desinformación al desacreditarla, pero a menudo no entienden el ecosistema", escribió esta semana. "Cuando interactúas con un post (incluso para desacreditarlo), lo impulsas en el algoritmo, haciendo que el original se propague aún más".

Las noticias son "demasiado arriesgadas"

Desde el atentado terrorista de Hamás en Israel, algunas personas han intentado informarse en Threads, la nueva plataforma de Meta similar a Twitter. Cientos de personas se amontonaron en los posts de Mosseri pidiendo herramientas en la plataforma que facilitaran la búsqueda de noticias de alta calidad. Mosseri, que ahora dirige Threads y antes pasó varios años supervisando el News Feed de Facebook, no está interesado.

"No estamos en contra de las noticias", escribió Mosseri la semana pasada. "Pero tampoco vamos a amplificar las noticias en la plataforma. Hacerlo sería demasiado arriesgado dada la madurez de la plataforma, los inconvenientes de prometer demasiado y lo que está en juego".

En otras palabras, ahora las noticias son un lío para nosotros. Threads sigue bloqueando en su herramienta de búsqueda algunas palabras habituales en las noticias, como "covid" y "vacuna". También se han dado casos de bloqueo de enlaces a noticias sobre Hamás e Israel, aunque el portavoz de Meta, Andy Stone, dijo el martes que el bloqueo de esos enlaces era "un error".

Hasta ahora, Zuckerberg no ha dicho nada públicamente sobre las noticias en Threads. Las acciones de su empresa en otros lugares se alinean con la nueva antipatía hacia las noticias duras expresada por Mosseri.

La empresa prefiere otra realidad: en la actualidad, la pestaña Noticias de Facebook es la opción número 18 en la barra de opciones en Estados Unidos, muy por debajo de una pestaña dedicada a la realidad virtual Meta Quest.

La pestaña Noticias está a punto de desaparecer del todo en el Reino Unido, junto con Francia y Alemania. En Canadá, se están bloqueando activamente los enlaces a noticias en Facebook e Instagram, debido a la legislación pendiente en el país que obligaría a la empresa a pagar por el contenido de las noticias.

X es para "estafadores"

En X, el servicio de verificación de pago que Musk ha puesto en marcha ofrece a cualquier usuario de pago una amplificación algorítmica. También hay un nuevo sistema de pago directo para quienes alcanzan un cierto nivel de engagement.

Según Alex Stamos, del Observatorio de Internet de Stanford y antiguo director de seguridad de Meta, estos cambios, combinados con los recortes de plantilla en la moderación de contenidos, han convertido a X en una plataforma en la que "estafadores individuales y equipos profesionales (a veces alineados con el Estado)" campan a sus anchas.

Business Insider ha pedido a Meta, X y TikTok información concreta sobre cómo trabajan para combatir la información falsa y no verificada.

Meta no ha querido dar detalles sobre las cuentas o publicaciones sobre las que ha tomado medidas, pero la empresa afirma que está supervisando activamente los contenidos relacionados con el conflicto y eliminando publicaciones.

"Después de los ataques terroristas de Hamás contra Israel el sábado, establecimos rápidamente un centro de operaciones especiales con expertos, incluyendo hablantes fluidos de hebreo y árabe, para vigilar de cerca y responder a esta situación de rápida evolución", explica un portavoz de Meta en un comunicado.

TikTok dice que ha "movilizado inmediatamente importantes recursos y personal", incluidos hablantes de árabe y hebreo para moderar los contenidos relacionados con el conflicto. Desde que comenzó el conflicto el 7 de octubre, TikTok ha eliminado "más de 500.000 vídeos y cerrado 8.000 retransmisiones en directo en la región afectada por violar nuestras directrices".

X no ha respondido a la pregunta de Business Insider. La consejera delegada Linda Yaccarino ha declarado que los usuarios tienen control sobre lo que ven en X. El mensaje parece ser que la empresa no intentará detener la información falsa, pero que los usuarios pueden optar por no ver determinadas publicaciones si así lo desean.

Otros artículos interesantes:

Conoce cómo trabajamos en Business Insider.